ALMA 是一个基于大型语言模型构建的开源机器翻译项目,旨在通过高质量的平行语料微调基础大模型,使其在不损失通用语言能力的前提下,展现出超越传统商业级翻译系统的表现。该项目采用了创新的两阶段微调策略,首先在目标语言单语数据上预训练以增强生成能力,随后利用少量极高质量的平行数据进行指令对齐。其进阶版本 ALMA-R 引入了对比偏好优化技术,在 WMT 等权威评测中性能甚至超越了 GPT-4。ALMA 支持多语种互译,涵盖中、英、德、法等主流语言,并深度集成于 Hugging Face 生态,方便开发者进行本地化部署与二次开发,是当前开源 AI 翻译领域的标杆工具。

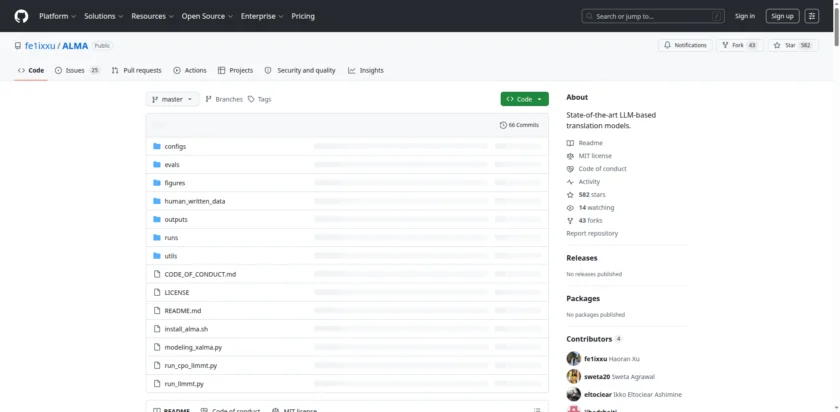

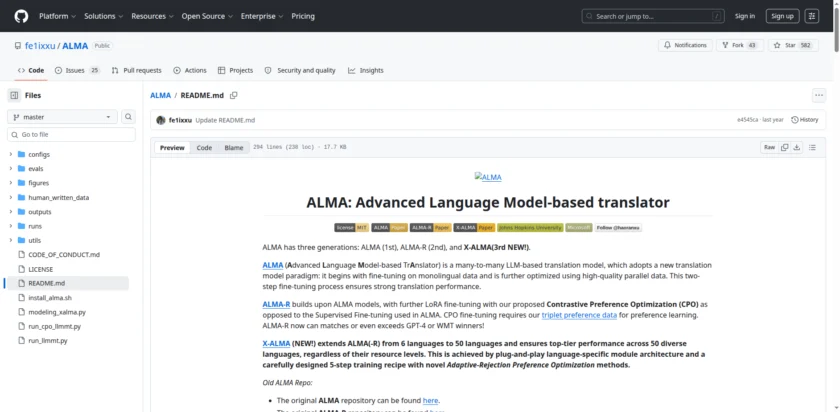

ALMA是什么?

ALMA(Advanced Language Model-based trAnslator)是一个基于大型语言模型(LLM)构建的开源机器翻译项目。该项目旨在通过高质量的平行语料微调基础大模型,使其在不损失通用语言能力的前提下,展现出达到甚至超越传统商业级机器翻译系统的翻译表现。

技术结构

- 基础架构:主要基于 LLaMA-2、LLaMA-3 或 Mistral 等主流开源仅解码器(Decoder-only)大语言模型构建。

- 优化策略:基础版本采用有监督微调(SFT);其进阶版本 ALMA-R 引入了对比偏好优化(Contrastive Preference Optimization, CPO),通过让模型学习区分高质量翻译与机器生成的劣质翻译,显著提升了翻译准确性与流畅度。

安装与运行

项目代码深度集成于 Hugging Face 生态,开发者可通过 Python 环境快速部署推理:

- 环境依赖:需要安装

torch、transformers、accelerate等常规深度学习和模型推理库。 - 加载调用:通过

AutoModelForCausalLM和AutoTokenizer即可从 Hugging Face Hub 直接拉取对应版本的模型权重。 - 推理执行:在输入阶段,需严格按照项目规定的提示词模板(Prompt Template)构造文本(例如包装为翻译指令),以激活模型的翻译能力并输出目标语言文本。

许可版本

- 模型版本:仓库及 Hugging Face 提供了包含 7B、13B 等不同参数量级的版本,分为初始微调版(ALMA)及偏好对齐增强版(ALMA-R)。

- 许可限制:项目相关代码通常遵循宽松的开源协议,但模型权重文件的具体使用权(尤其是商业化)严格受限于其底层基础模型(如 Meta LLaMA 许可协议)的开源条款。

适用人群

- NLP 研究人员:用于探索大语言模型在跨语言任务、机器翻译微调以及人类偏好对齐(RLHF/CPO)方向的前沿研究。

- AI 工具开发者:需要私有化部署高精度、离线多语种翻译接口的技术团队。

- 开源 AI 实践者:寻求替代传统神经机器翻译(NMT)架构,探索大语言模型翻译上限的开发者。

核心能力与技术结构

技术架构与核心逻辑

ALMA(Advanced Language Model-based Adaptor)采用了基于大语言模型(LLM)的渐进式微调架构,其核心逻辑在于通过“两阶段策略”将通用语言能力转化为专业的翻译能力。该项目在 LLaMA-2 基础上进行开发,打破了传统神经机器翻译(NMT)依赖海量平行语料的局限。

- 第一阶段:单语微调(Monolingual Fine-tuning):在目标语言的单语语料库上进行预训练,旨在增强模型对特定语言特征、语法结构和文化语境的深度理解。

- 第二阶段:高质量平行语料微调:利用规模较小但质量极高的双语平行数据进行对齐,使模型掌握精确的跨语言映射能力。

- 对比偏好优化(CPO/DPO):在进阶版本 ALMA-R 中,引入了偏好对齐技术,通过对比模型生成的优质翻译与劣质翻译,进一步提升翻译的自然度和准确性。

模型版本与规格

ALMA 提供了多种参数规模和微调形式的模型,以适应不同的计算资源环境:

| 模型名称 | 基础架构 | 微调方式 | 适用场景 |

|---|---|---|---|

| ALMA-7B / 13B | LLaMA-2 | 全参数微调 | 高性能服务器,追求极致翻译质量 |

| ALMA-7B-LoRA | LLaMA-2 | LoRA 轻量化 | 消费级显卡,低成本部署与实验 |

| ALMA-R | LLaMA-2 / ALMA | LoRA + CPO | 需要超越 GPT-4 翻译表现的专业领域 |

安装与运行环境

ALMA 托管于 GitHub,开发者可以通过以下步骤快速搭建运行环境:

- 基础环境:需要 Python 3.10+ 以及支持 CUDA 的 PyTorch 环境。

- 依赖安装:通过仓库提供的

requirements.txt安装必要库,核心依赖包括transformers、peft(用于加载 LoRA 权重)和accelerate。 - 权重获取:模型权重已发布至 Hugging Face。若使用 LoRA 版本,需先加载基础 LLaMA-2 模型,再合并 LoRA 适配器。

- 推理运行:项目提供了

inference.py脚本,支持通过命令行输入源文本并指定目标语言代码(如 de、en、cs、is、zh 等)进行实时翻译。

许可协议与适用人群

ALMA 的代码部分遵循 MIT License 开源协议,具有极高的商用自由度。但由于其模型权重基于 LLaMA-2,用户在使用权重文件时必须同时遵守 Meta Llama 2 Community License。该工具主要面向以下群体:

- AI 研究员:探索 LLM 在翻译任务中的微调极限及偏好对齐技术。

- 翻译服务开发者:寻求构建高性能、低延迟的自托管翻译引擎,替代昂贵的商用 API。

- 开源社区爱好者:在本地设备上部署能够媲美甚至超越 GPT-4 翻译水平的轻量化模型。

安装与运行

技术架构与核心原理

ALMA(Advanced Language Model-based Adaptive translation)是一系列基于大语言模型(LLM)的全参数微调翻译模型。与传统的神经机器翻译(NMT)架构不同,ALMA 采用了 LLaMA-2 或 LLaMA-3 作为基础模型,通过创新的“两阶段微调”策略显著提升了翻译质量:

- 第一阶段:目标语言单语微调。在目标语言的单语数据上进行预训练,使模型具备深度的目标语言理解与生成能力。

- 第二阶段:高质量平行语料微调。利用少量但极高质量的平行数据进行指令微调,确保翻译的准确性与对齐效果。

- 进阶版本(ALMA-R):在上述基础上引入了基于人类反馈的对比学习(DPO),利用模型生成的翻译候选结果进行偏好对齐,进一步突破了传统微调的性能瓶颈。

环境准备与安装步骤

ALMA 托管于 GitHub 开源社区,其运行环境依赖于主流的深度学习框架。建议在具备 NVIDIA GPU(建议显存 24GB 以上)的 Linux 环境下运行。以下是基础安装流程:

- 克隆仓库:通过 Git 获取源代码。

git clone https://github.com/fe1ixxu/ALMA.git cd ALMA - 安装依赖:需要安装 PyTorch、Transformers 以及用于高效微调的 PEFT 库。

pip install torch torchvision torchaudio pip install transformers>=4.34.0 pip install peft accelerate sentencepiece - 模型权重下载:用户可以从 Hugging Face 模型库直接加载预训练好的权重,包括 ALMA-7B、ALMA-13B 以及最新的 ALMA-7B-R 等版本。

模型版本对比

ALMA 提供了多个迭代版本,以适应不同的计算资源和翻译质量需求:

| 版本名称 | 基础模型 | 核心特性 | 适用场景 |

|---|---|---|---|

| ALMA-7B/13B | LLaMA-2 | 两阶段微调,支持 10 种语言对 | 基础翻译任务,低资源消耗 |

| ALMA-R | ALMA-7B/13B | 引入 DPO 算法,性能超越 GPT-4 | 高质量专业翻译,学术研究 |

| ALMA-LoRA | LLaMA-2 | 轻量化适配器版本 | 消费级显卡部署,快速微调 |

运行与推理示例

ALMA 采用指令式触发翻译任务。在运行推理时,需要严格遵守特定的 Prompt 格式以获得最佳效果。以下是使用 Python 调用 Transformers 库进行推理的代码片段:

from transformers import AutoModelForCausalLM, AutoTokenizer

model_name = "haoranxu/ALMA-13B-R"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(model_name, device_map="auto")

# 构造翻译指令 prompt = "Translate this from English to Chinese:\nEnglish: ALMA is a powerful translation model.\nChinese:"

input_ids = tokenizer(prompt, return_tensors="pt").input_ids.to("cuda")

# 生成翻译结果 outputs = model.generate(input_ids, max_new_tokens=50)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))许可协议与适用人群

ALMA 的代码部分遵循 Apache License 2.0 协议开源。由于其模型权重基于 LLaMA 系列,用户在使用时还必须遵守 Meta 发布的 Llama Community License。该工具主要面向以下群体:

- 自然语言处理研究者:用于探索 LLM 在翻译领域的架构优化及微调策略。

- 开发者:构建高性能的自托管翻译服务,替代昂贵的商用翻译 API。

- 本地化团队:利用 ALMA-R 的高准确度进行大规模文本的初步翻译与校对。

许可、版本与社区

开源许可协议

ALMA 项目的代码实现遵循 Apache-2.0 License 开源协议,允许开发者进行自由的代码分发、修改及商业化使用。但需要注意的是,由于 ALMA 模型是基于 Meta 的 LLaMA-2 架构构建的,其模型权重(Weights)的使用必须同时遵守 LLaMA-2 Community License。用户在将其应用于大规模商业场景前,需确保符合 Meta 关于月活跃用户数等相关条款的限制。

版本演进与核心差异

ALMA 提供了多个迭代版本,以满足从基础翻译到高质量对齐的不同需求:

| 版本 | 技术路径 | 基础模型 | 主要优势 |

|---|---|---|---|

| ALMA (V1) | 两阶段微调(预训练 + 指令微调) | LLaMA-2-7B/13B | 建立了强大的多语言翻译基准,支持 10 种语言对。 |

| ALMA-R | 对比偏好优化 (CPO) | ALMA-13B-LoRA | 通过 CPO 算法进行偏好对齐,翻译质量在 WMT 评测中超越了 GPT-4。 |

技术结构与环境安装

ALMA 采用了模块化设计,支持全量微调与 LoRA 轻量化微调。开发者可以通过以下步骤快速搭建运行环境:

- 克隆仓库: 访问 GitHub 获取最新源代码。

- 依赖安装: 需要 Python 3.10+ 环境,核心依赖包括

torch、transformers、peft以及accelerate。 - 权重加载: 项目支持从 Hugging Face 自动下载模型。对于 ALMA-R 版本,需先加载 LLaMA-2 基础模型,再挂载相应的 LoRA 适配器。

pip install -r requirements.txt

# 示例:使用 Transformers 加载模型 from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained("haoranxu/ALMA-13B-R")适用人群与社区支持

ALMA 主要面向以下群体:

- 自然语言处理研究者: 探索大语言模型在翻译任务中的微调策略及偏好对齐技术。

- 多语言应用开发者: 寻求高性能、可本地化部署的开源翻译替代方案。

- 社区贡献: 项目在 GitHub 上保持活跃,用户可以通过提交 Issue 反馈模型在特定语种下的表现,或通过 Hugging Face 获取社区分享的衍生微调版本。

适合谁?

技术架构与核心优势

ALMA(Advanced Language Model-based Adaptor)代表了从传统编码器 - 解码器架构向仅解码器(Decoder-only)大语言模型翻译转型的技术趋势。该项目在 GitHub 上开源,其核心在于提出了一种两阶段微调策略:首先在目标语言的单语数据上进行预训练以增强语言建模能力,随后利用少量高质量的平行数据进行多向指令微调。这种架构使得 ALMA-13B 在 WMT 评估任务中展现出超越 GPT-3.5-Turbo 和拥有 545 亿参数的 NLLB 模型的翻译质量。

部署要求与许可说明

该工具适合具备一定技术背景的用户进行本地化部署。其运行环境基于 Python 和 PyTorch 框架,开发者可以通过 Hugging Face 快速调用预训练权重。项目提供了包括 ALMA-7B、ALMA-13B 以及基于 LoRA 技术的轻量化版本,以适应不同显存配置的 GPU 设备。在许可方面,ALMA 遵循其基础模型 LLaMA-2 的社区许可协议,允许在满足相关条款的前提下进行学术研究和商业用途。

适用人群与应用场景

- NLP 算法工程师: 适合作为研究大语言模型翻译能力、指令微调策略以及跨语言迁移学习的基准模型。

- 翻译工具开发者: 适合需要集成高性能翻译 API 的技术团队,通过本地部署 ALMA 模型,可以获得比通用 LLM 更精准的特定语向翻译效果。

- 企业级本地化团队: 适合对数据隐私有严格要求、无法使用闭源在线翻译服务的企业,用于构建私有化的机器翻译系统。

- 多语言研究者: 适合处理中、英、德、法、俄、冰岛语等多种语言互译任务,并追求高 BLEU 分数和 COMET 指标的专业用户。

版本规格对比

| 模型版本 | 基础架构 | 适用场景 |

|---|---|---|

| ALMA-7B / 13B | LLaMA-2 全量微调 | 追求极致翻译质量,具备充足显存资源的环境。 |

| ALMA-7B-LoRA | 低秩自适应微调 | 显存受限的消费级显卡,或需要快速迭代验证的场景。 |

| ALMA-R | 对比学习增强版 | 对翻译幻觉有严格控制要求,追求更高忠实度的任务。 |

优势与局限

技术结构与许可版本

ALMA(Advanced Language Model-based Translator)采用了基于 LLaMA 系列大语言模型的架构,其核心技术在于“两阶段微调”策略:第一阶段利用大规模单语数据进行预训练,使模型适应目标语言的分布;第二阶段通过高质量的平行语料进行指令微调。该项目在 GitHub 上完全开源,模型权重托管于 Hugging Face。其许可协议遵循底层模型(如 LLaMA-2 或 LLaMA-3)的社区许可协议,通常允许学术研究使用,并在满足特定用户规模条件下允许商业化部署。

安装运行与适用人群

ALMA 主要面向 AI 研究人员、翻译系统开发者以及对翻译质量有极致追求的技术极客。其运行环境要求如下:

- 环境依赖: 需要 Python 3.8+、PyTorch 以及 Hugging Face 的 Transformers 库。

- 硬件要求: 由于基于大参数量模型,建议配备 24GB 以上显存的 GPU(如 RTX 3090/4090)。

- 部署优化: 支持通过 BitsAndBytes 进行 4-bit 或 8-bit 量化加载,显著降低了消费级硬件的运行门槛。

- 调用方式: 开发者可以通过简单的 Python 脚本调用

AutoModelForCausalLM接口实现自动化翻译流。

核心优势

| 维度 | 优势描述 |

|---|---|

| 翻译质量 | 在 WMT 测试集上,ALMA 的表现多次超越 Google Translate 等传统神经机器翻译(NMT)系统。 |

| 多语言支持 | 支持多对多翻译,涵盖英语、中文、德语、法语、冰岛语、俄罗斯语等多种主流及小众语言。 |

| 可定制性 | 作为开源项目,用户可以利用特定领域的私有语料对模型进行二次微调,以适配医疗、法律等专业术语。 |

| 上下文理解 | 相比传统逐句翻译,基于 LLM 的 ALMA 具有更强的长文本上下文连贯性处理能力。 |

局限性说明

- 计算资源消耗: 尽管支持量化,但与轻量级的传统 NMT 模型相比,其推理延迟较高且对算力依赖较强。

- 幻觉风险: 作为生成式模型,在处理极生僻词汇或缺乏上下文的短句时,可能产生看似通顺但违背原文事实的“幻觉”内容。

- 数据敏感性: 翻译效果高度依赖于微调阶段平行语料的质量,在未覆盖的稀有语种上表现可能大幅下降。

结论

ALMA(Advanced Language Model-based Adaptor)代表了机器翻译从传统神经机器翻译(NMT)向大语言模型(LLM)架构演进的重要突破。其技术结构核心在于采用了两阶段微调策略:首先在单语数据上进行预训练以增强目标语言生成能力,随后在少量高质量平行语料上利用 LoRA(Low-Rank Adaptation) 技术进行参数高效微调。这种结构使得 ALMA 在保持较低计算资源需求的同时,在 WMT 等权威评测任务中展现出超越传统翻译引擎的性能。

技术实现与部署

在安装运行方面,ALMA 深度集成于 Hugging Face 生态系统,开发者需准备 Python 3.10+ 及 PyTorch 环境。核心依赖库包括 transformers、peft 和 accelerate。通过以下方式可快速加载模型:

from transformers import AutoModelForCausalLM, AutoTokenizer

model = AutoModelForCausalLM.from_pretrained("haoranxu/ALMA-13B-R")

tokenizer = AutoTokenizer.from_pretrained("haoranxu/ALMA-13B-R")许可版本与适用人群

ALMA 的源代码遵循 MIT 许可证开源,具有极高的商用友好度;但需注意,其模型权重(如基于 LLaMA-2 或 LLaMA-3 构建的版本)需同时遵守 Meta 的社区许可协议。该工具主要面向以下群体:

- 翻译技术研究者: 用于探索 LLM 在多语言对齐与指令微调方面的学术边界。

- 企业开发者: 适合作为构建私有化、高精度翻译中台的基础底座。

- 本地化从业者: 针对特定领域语料进行二次微调,以获得优于通用翻译工具的术语准确性。

总的来说,ALMA 证明了通过精细化的数据选择和高效的微调算法,通用大模型能够克服传统翻译模型在长文本理解和复杂语境下的局限性,是当前开源 AI 翻译领域的标杆项目。

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/alma.html -APPMARK

STranslate是一款由开发者 ZGGSONG 基于 WPF(Windows Presentation Foundation)技术开发的多功能翻译和 OCR(光学字符识别)工具。