Baseten 是一个专注于机器学习模型部署与服务的无服务器推理平台。它旨在帮助开发者摆脱底层基础设施管理的负担,实现模型从开发环境到生产环境的快速迁移。通过 Baseten,用户可以轻松部署各类深度学习模型,并获得自动扩缩容、版本控制以及监控告警等生产级能力。平台支持 PyTorch、TensorFlow 等主流框架,并提供开源工具 Truss 简化模型打包流程,让开发者能够专注于模型逻辑本身,快速构建高性能的 AI 推理服务。

Baseten是什么?

Baseten 是一个专注于机器学习模型部署与服务的无服务器推理平台。它旨在帮助开发者摆脱底层基础设施管理的负担,实现模型从开发环境到生产环境的快速迁移。通过 Baseten,用户可以轻松部署各类深度学习模型,并获得自动扩缩容、版本控制以及监控告警等生产级能力。

核心功能

- 无服务器架构:平台自动处理基础设施配置,支持根据流量自动扩缩容,包括缩放至零以优化成本。

- 高性能 GPU 支持:提供多种 NVIDIA GPU 实例选择(如 A10G、A100),满足不同规模的推理需求。

- 广泛的框架兼容性:原生支持 PyTorch、TensorFlow、scikit-learn、ONNX 以及 Hugging Face 等主流模型框架。

- Truss 开源工具:提供名为 Truss 的开源模型打包工具,简化模型容器化与依赖管理流程。

- 自动 API 生成:部署完成后自动生成 RESTful API 端点,方便前端应用或其他服务直接调用。

使用方式

Baseten 采用 Python 优先的设计理念,用户只需编写少量代码即可完成部署:

- 模型打包:使用 Truss 库将本地模型打包,定义依赖环境与推理逻辑。

- 云端部署:通过命令行工具或 Web 控制台将打包好的模型推送至 Baseten 平台。

- API 调用:部署成功后,获取自动生成的 API 地址,通过 HTTP 请求进行模型推理调用。

获取方式

用户可访问 Baseten 官网注册账户。平台提供免费试用额度供开发者测试,同时也提供按量付费的企业级方案。

核心功能

Baseten 是一个专为机器学习模型部署与推理设计的全托管平台。它致力于解决模型从开发环境到生产环境的“最后一公里”问题,让数据科学家和工程师能够专注于模型本身,而无需耗费精力构建和维护复杂的底层基础设施。该平台支持各类主流 ML 框架,提供从模型打包、部署到监控的一站式解决方案。

模型打包与部署

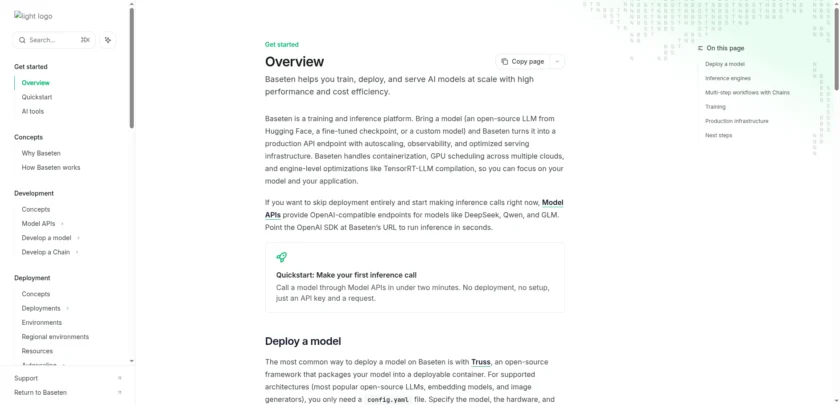

Baseten 的核心构建块是 Truss,这是一个开源的模型打包工具。用户可以通过 Truss 将模型代码、权重和依赖项封装成标准格式,实现与 Baseten 平台的无缝对接。平台原生支持 PyTorch、TensorFlow、scikit-learn、XGBoost 以及 Hugging Face 等主流框架和库,开发者仅需编写少量 Python 代码即可完成部署,极大地降低了模型服务化的门槛。

高性能推理与自动扩缩容

平台提供强大的推理能力,支持 CPU 和 GPU(包括 NVIDIA A100、A10G、T4 等)实例。Baseten 具备自动扩缩容功能,能够根据实时流量自动调整计算资源,在流量高峰期保障服务稳定性,在空闲时缩减资源以节约成本。这种无服务器架构确保了低延迟和高吞吐量,满足生产级应用需求。

API 集成与可观测性

部署完成后,Baseten 会为每个模型自动生成标准的 REST API 端点,方便开发者将其集成到 Web 应用、移动应用或后端服务中。平台内置了完善的可观测性工具,用户可以实时监控模型调用情况、查看日志并追踪性能指标。此外,平台支持流式响应,特别适用于大语言模型(LLM)的文本生成场景。

使用方式

使用 Baseten 的流程极为简化,主要包含以下步骤:

- 环境配置:在本地安装 Baseten Python 客户端并配置 API Key。

- 模型封装:使用 Truss 工具将本地模型打包,定义预测逻辑。

- 部署上线:运行部署命令,平台自动构建容器镜像并分配计算资源。

- 调用测试:通过生成的 HTTP 接口发送请求,获取推理结果。

获取方式

Baseten 采用按量付费模式,用户仅需为模型推理实际消耗的计算资源付费,无需预付基础设施费用。平台提供免费额度供新用户试用,同时也提供企业级方案以满足合规、安全及私有化部署需求。

如何开始使用?

Baseten 是一个专为机器学习模型部署设计的无服务器推理平台,致力于解决模型从开发到生产环境的“最后一公里”问题。它允许开发者在无需管理底层服务器基础设施的前提下,快速部署、扩展并运行高性能 AI 模型。平台核心定位在于提供生产级的模型服务能力,支持自动扩缩容、GPU 加速以及高并发处理,确保模型推理的低延迟与高吞吐。

开始使用 Baseten 主要包含以下几个关键步骤:

- 创建账户与登录:访问 Baseten 官网注册账户。新用户通常可以获得免费试用额度,用于体验平台的部署与推理功能。完成注册后,在设置页面获取 API 密钥,用于后续的本地环境认证。

- 环境配置:在本地开发环境中安装 Baseten 的 Python 库和命令行工具。通过运行

pip install baseten命令即可完成安装。安装完成后,使用baseten login命令并通过 API 密钥进行身份验证,将本地环境与云端账户关联。 - 模型打包:Baseten 推荐使用开源工具 Truss 对模型进行打包。Truss 能够将模型代码、权重文件、依赖项以及推理逻辑封装成一个标准化的结构。这种打包方式不仅简化了部署流程,还确保了模型在不同环境中的一致性。

- 部署模型:利用 Truss 打包好模型后,可以通过简单的 Python 脚本或 CLI 命令将模型推送到 Baseten 平台。平台会自动配置所需的基础设施,包括 CPU 或 GPU 资源,并生成一个可调用的 REST API 端点。

- 调用与监控:部署完成后,用户会获得一个专属的 API 地址。开发者可以使用标准的 HTTP 请求调用模型进行推理。同时,Baseten 提供了仪表盘界面,用户可以实时监控模型的调用次数、延迟指标以及资源使用情况,并根据业务负载调整实例配置。

除了自定义模型,Baseten 还提供了一系列预训练模型的快速部署方案,用户可以直接在模型库中选择如 Stable Diffusion、Whisper 等热门模型进行一键部署,极大地降低了 AI 能力的接入门槛。

价格或获取方式

Baseten 定位为高性能的机器学习模型推理服务平台,致力于简化模型部署与运维流程。用户可直接访问 Baseten 官网注册账户,支持 GitHub 或 Google 账号快捷登录,无需绑定信用卡即可开始体验。

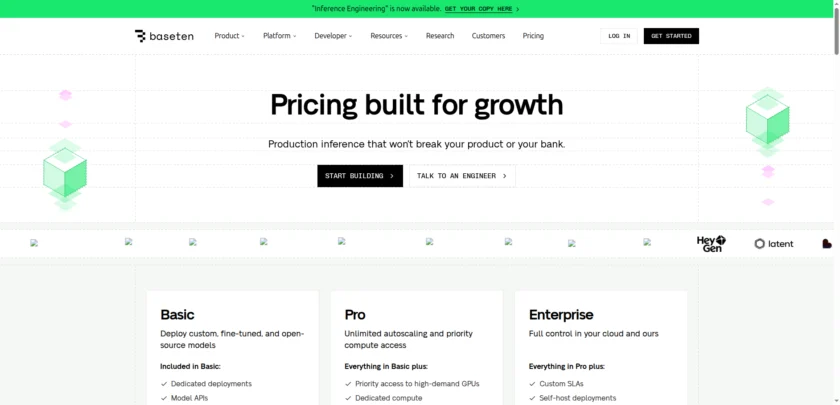

平台采用订阅与资源用量结合的计费模式,主要包含以下定价方案:

- Free(免费版):适合个人开发者与原型测试,提供每月固定的免费推理额度,支持 CPU 和部分 GPU 实例,适合低频调用与功能验证。

- Team(团队版):面向生产级应用,按用户席位收取固定月费,计算资源按实际使用时长(秒级)计费,包含自动扩缩容、日志监控及团队协作功能。

- Enterprise(企业版):针对大规模企业需求,提供定制报价,包含专属技术支持、SSO 单点登录、合规审计及私有化部署方案。

在获取与使用上,开发者需使用 Baseten 提供的开源工具 Truss 对模型进行打包封装。完成打包后,通过 CLI 命令行或 Web 界面推送模型,系统将自动构建 API 接口并处理负载均衡。平台支持 PyTorch、TensorFlow 等主流框架,用户可按需选择不同的 GPU 硬件配置以优化推理性能。

适合谁?

Baseten 作为一个无服务器模型推理平台,主要服务于希望摆脱基础设施管理负担、专注于模型交付的技术团队。其核心定位在于提供高性能、可扩展的模型部署体验,特别适合以下用户群体:

- 机器学习工程师与数据科学家:平台支持 Python 原生开发,通过开源工具 Truss 打包模型,无需深入学习 Kubernetes 或容器化细节,即可将 PyTorch、TensorFlow 等框架训练的模型快速推向生产环境。

- 构建 AI 产品的初创团队:对于需要快速迭代和验证 AI 功能的团队,Baseten 提供自动扩缩容能力,能够根据请求流量实时调整 GPU 资源,在保证低延迟响应的同时优化成本。

- 需要运行大模型的企业:无论是部署 LLM 还是图像生成模型,平台提供多种 GPU 实例选择,满足高吞吐量的推理需求,适合对性能和稳定性有严苛要求的企业级应用场景。

用户只需在官网注册账号即可开始使用,平台提供免费试用额度,后续采用按量计费模式,降低了接入门槛。

优势与局限

Baseten 定位为面向机器学习团队的无服务器模型部署平台,旨在解决模型从开发环境到生产环境的“最后一公里”难题。它允许开发者专注于 Python 代码与模型逻辑,而无需深入钻研 Kubernetes 或底层基础设施配置,从而实现高性能模型推理服务的快速上线。

核心优势

- Python 原生开发体验: 开发者可直接使用 Python 编写推理逻辑,无需编写复杂的 Dockerfile 或 Kubernetes YAML 配置文件,显著降低了工程门槛。

- 高性能自动扩缩容: 平台支持基于请求流量的自动扩缩容机制,能够实现从零实例的快速冷启动,既保障了突发流量下的服务稳定性,又能在空闲时节省计算成本。

- Truss 开源工具链集成: Baseten 深度集成了开源模型打包工具 Truss,支持 PyTorch、TensorFlow、Hugging Face 等主流框架,确保模型环境的一致性与可移植性。

- 企业级 GPU 支持: 提供包括 NVIDIA A10G、A100 在内的多种高性能 GPU 实例选择,并通过优化的推理运行时,最大化硬件利用率,适合部署大语言模型(LLM)及 Stable Diffusion 等高算力需求模型。

局限与考量

- 运维责任转移: 虽然平台屏蔽了基础设施细节,但用户仍需对模型权重、依赖库版本及推理代码的维护负责,这与直接调用 API 的 SaaS 服务相比,具备一定的技术门槛。

- 成本控制挑战: 对于需要长时间运行或高并发的大型模型,GPU 实例的费用累积较高。尽管支持缩容至零,但频繁的冷启动可能影响用户体验,需在成本与性能间寻找平衡。

- 生态绑定风险: 虽然 Truss 工具支持导出并在其他平台运行,但深度使用 Baseten 的特有功能(如特定的监控面板或权限管理)可能会产生一定的平台迁移成本。

用户可通过 Baseten 官网注册账户,采用按量付费模式开始使用,平台通常提供免费额度供开发者进行初步测试与验证。

结论

Baseten 定位为高性能的机器学习模型推理平台,旨在帮助开发者摆脱基础设施管理的负担,专注于模型核心逻辑的实现。作为一个“模型接入平台”,它通过无服务器架构提供了从模型打包到生产部署的一站式解决方案。

核心功能亮点:

- Truss 模型打包: 利用开源工具 Truss 简化模型容器化过程,支持 PyTorch、TensorFlow 等主流框架,确保环境一致性。

- 弹性伸缩架构: 提供自动扩缩容能力,支持缩容至零以优化成本,同时具备 GPU 加速推理能力,满足高并发生产需求。

- 便捷的 API 集成: 部署完成后自动生成 RESTful API 接口,配合 Python SDK 可快速将模型能力接入各类应用。

使用与获取方式:

开发者可访问 Baseten 官网注册账户,通过 Python 代码本地打包模型并推送至云端即可完成部署。平台提供免费层级供试用,后续采用按量计费模式,适合不同规模的 AI 项目快速落地。

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/baseten.html -APPMARK

Openlayer 是一个先进的机器学习评估工作空间平台,旨在帮助数据科学家和机器学习工程师从头开始构建高质量、可信赖的模型。