Fal.ai 是一个面向开发者的生成式媒体基础设施平台,把海量图像、视频、音频和 3D 模型 API、无服务器推理、按需 GPU 集群以及模型部署能力放到同一套产品里。它适合正在搭建 AI 图像或视频产品、需要快速接入多模型能力、或者想把自定义模型上线成稳定服务的团队,因为它解决的不是单次试玩,而是从原型验证到生产部署的整条工程链路。

这是什么产品

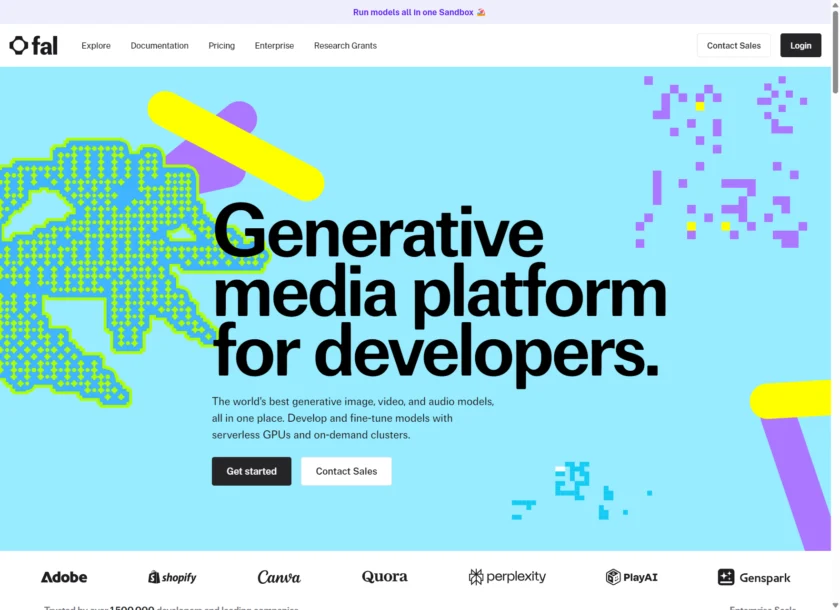

Fal.ai 首页把自己定义为 “Generative media platform for developers.”,这一定义很准确地说明了它的目标用户和产品边界。它不是一个面向普通消费者的聊天或生成网页,也不是只提供单一模型的 API 入口,而是一套围绕开发者工作流设计的生成式媒体平台。首页公开文案同时强调 image、video、audio、3D models、serverless GPUs、on-demand clusters、fine-tune 和 deploy,这表明它想承接的不是单点能力,而是生成式媒体产品的整条基础设施路径。

从首页信息看,Fal.ai 的核心卖点有两个层次。第一个层次是模型接入与模型分发。官网写明平台提供 1000+ production-ready models,并强调都可以通过统一 API 访问。第二个层次是运行与部署基础设施。除了直接调用公开模型,它还提供无服务器推理引擎、按需 GPU、模型训练和专用集群。这意味着 Fal.ai 的价值不止在于“模型很多”,而在于它把模型调用、模型上线、性能和扩展性放进了同一套面向开发者的操作界面和 API 体系里。

这也解释了为什么它在随机未发布候选里是一个很适合做发布回归测试的对象。对于 AI 开发平台类工具,真正重要的不是漂亮的营销语,而是能不能从官网上清楚看到能力边界、上手路径和价格逻辑。Fal.ai 首页在这点上信息密度很高:你能直接看到它既支持直接使用现成模型,也支持定制与部署自己的模型,还能往下延伸到企业级规模和专用 GPU 资源。

核心功能与使用体验

Fal.ai 的第一类核心能力,是统一调用大量生成式媒体模型。首页与 Explore 页面都明确展示了这一点:平台覆盖图像、视频、音频、语音、3D 等模态,既有公开模型,也有热门模型和新模型入口。对于开发者来说,这种统一入口的意义很直接,你不需要分别去接每个模型供应商的 API,再为每个模型单独处理调用方式、计费逻辑和扩展性问题,而是可以在同一平台里完成发现、测试和接入。

第二类能力,是推理与部署基础设施。官方首页强调 on-demand, serverless GPUs,并提到 scale from zero to thousands of GPUs instantly,同时又提供 dedicated clusters for frontier research labs。这说明 Fal.ai 同时覆盖了轻量原型和大规模生产两种需求。你可以从一个简单的模型 API 调用开始,也可以继续向前走到模型训练、微调、专用集群和企业级推理部署。对很多团队来说,这比单纯接一个模型 API 更有吸引力,因为它减少了从“做 demo”到“真上线”之间的体系切换。

第三类能力,是围绕生成式媒体产品做工程化优化。首页写到 unified API and SDKs、no MLOps、no setup、best in class observability toolchain,这说明它的卖点并不只是模型质量,还包括部署效率、可观测性和工程摩擦控制。对真正要做 AI 图像、视频或音频功能的人来说,这类工程特性通常比一两个营销口号更重要,因为产品上线后要面对的是延迟、稳定性、扩容和成本,而不是“页面演示看起来有没有惊艳”。

模型生态与分发方式

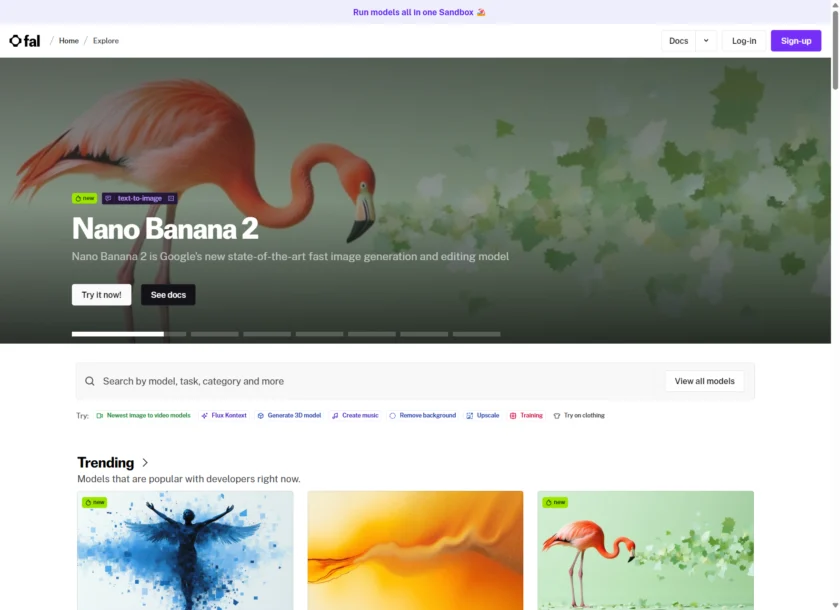

Fal.ai 的 Explore 页面很好地体现了它的“模型分发层”定位。这个页面不是单纯的品牌介绍页,而是一个明显面向模型发现和模型比较的入口。当前页面可以看到热门模型、最新模型、按任务分组的模型,以及大量图像与视频模型卡片。它不是要求用户先决定某一个品牌,而是先让开发者看清楚“现在有哪些模型可用、哪些模型更热门、哪些模型值得直接接 API”。

这对于开发工作流非常重要。因为很多团队在接入生成式 AI 能力时,最先遇到的问题并不是“怎么写 SDK”,而是“到底先选哪个模型做产品原型”。Fal.ai 的 Explore 页面把这个前置阶段产品化了:你可以先浏览模型,再结合价格与能力判断应该接哪一类 endpoint。对于需要快速试错的团队,这个体验比逐个去各家官网找模型接口高效得多。

从截图可见,Explore 页面当前顶部直接展示具体模型卡片和趋势模型,这说明 Fal.ai 的分发方式偏向“直接让开发者上手模型”,而不是藏在深层文档后面。配合首页提到的 unified API 和 production-ready models,这种展示方式进一步强化了它的角色:它是模型发现、模型调用和模型部署之间的桥梁。

如何开始使用

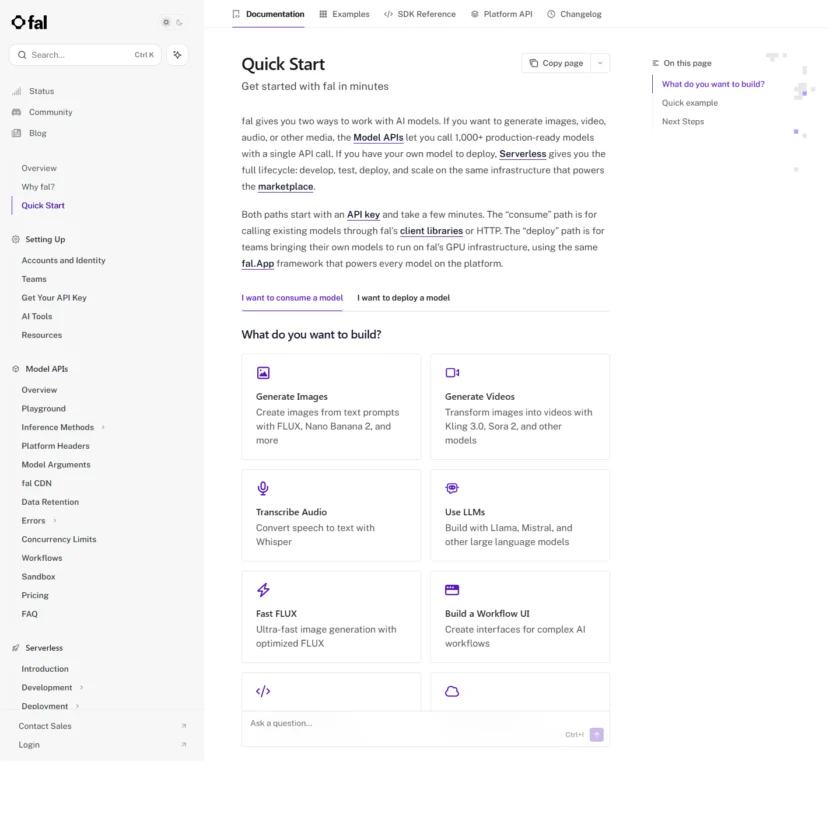

Fal.ai 的 quick start 页面比根文档页更适合做上手入口,因为它直接把开发者的起步路径压缩成几个核心步骤。官方文档页写明平台支持通过 unified API 调用 1000+ optimized models,也支持在同一基础设施上部署自己的模型。对于第一次使用的人,最合理的路径不是先研究所有文档目录,而是先从 quick start 或 model API call 开始,验证一个最小的生成任务能否跑通。

从文档与首页公开信息综合看,Fal.ai 的入门过程大致可以概括为:先选一个公开模型,通过统一 API 或 SDK 发起调用,确认输入输出链路可用;再根据业务决定是否需要更深的 serverless、compute 或自定义部署能力。文档页同时列出 Start with a Model API Call、Deploy Your Own Models、Train Your Own Models,说明官方本身就是把上手路径设计成逐层深入,而不是要求所有人一开始就进入最复杂的训练和集群场景。

对开发者来说,这种路径很合理。因为你不需要先具备完整的 MLOps 栈才有资格试用产品,而是可以先把业务侧最需要的生成能力跑起来,然后再决定是否继续用它承接更复杂的部署需求。与很多只能做 demo 的模型目录相比,Fal.ai 文档页更强调“从调用到生产”的连续性;与很多纯基础设施产品相比,它的上手门槛又明显更低,因为公开模型 API 本身就能作为最小验证入口。

价格、开源与部署方式

Fal.ai 的价格页给出的核心信息是“按使用量和算力形态付费”。官方明确写到,你只需要为实际消耗的算力付费;Serverless 与 Compute 分别适合不同场景,并且公开给出了 GPU 资源起价。价格页写明 H100 可以低至每小时 1.89 美元起,这说明它不是模糊地说“联系我们报价”,而是至少对部分基础设施价格给出了明确锚点。

在部署形态上,Fal.ai 不是传统意义上的本地软件,也不是一个单一 SaaS 功能页,而是云端 AI 基础设施平台。你既可以直接调用它托管的模型 API,也可以部署自己的应用或模型到它的 GPU 资源上。首页提到 serverless engine、dedicated compute、fine-tune 和 enterprise-grade reliability,说明它在产品设计上本来就包含了不同层级的部署路线:轻量调用、定制推理、专用资源、企业支持。

开源方面需要谨慎表述。当前公开页面重点在于开放模型调用和部署平台能力,而不是把 Fal.ai 本身描述成开源产品。因此更稳妥的结论是:Fal.ai 是商业化的开发平台,提供面向开发者的模型 API、计算资源与部署服务;如果团队有完全自托管或极强私有化需求,仍然需要继续核实它是否满足那类环境的约束。

适合哪些人和场景

Fal.ai 最适合三类用户。第一类是正在把图像、视频、语音或 3D 生成能力接进产品的开发团队。对这类团队来说,Fal.ai 的价值在于它能把模型调用、推理性能和部署延展性放到一个平台里,而不是让你自己拼接多套服务。第二类是需要快速横向试模型的人,例如做 AI 创意产品、媒体工具、生成式应用原型的人,他们通常需要一个地方同时发现和调用大量模型。第三类是已经开始考虑训练、微调、专用 GPU 或企业规模推理的人,这时 Fal.ai 的 compute 和 dedicated cluster 能力会比单纯的模型 API 更有吸引力。

从场景上看,它尤其适合那些“模型能力本身就是产品核心”的团队。例如 AI 图像生成、AI 视频创作、音频工具、内容自动化和多模态创作产品。因为这类产品通常不仅要关心模型结果,还要关心速度、可扩展性、成本和后续运维。Fal.ai 官网在这些问题上给出的信息足够多,说明它并不是只想服务于玩具级别的实验,而是明确在做生产级平台。

优势与限制

Fal.ai 的明显优势首先是覆盖面广。它不是单个模型或单种模态服务,而是生成式媒体能力平台。第二个优势是从原型到生产的路径比较连贯。很多平台在 demo 阶段很好用,但一旦进入扩容、集群、观测或训练阶段就要切栈;Fal.ai 则试图把这些阶段放在同一个产品体系里。第三个优势是它对开发者比较友好,至少从官方公开文案看,统一 API、serverless inference、compute、observability 和模型发现都被产品化了。

限制也很清楚。第一,它天然更偏向技术团队,而不是完全不懂开发的普通用户。第二,平台能力越强,评估时越不能只看首页文案,还必须具体回到模型、成本和部署方式去判断,尤其在长期推理成本和 GPU 计费上。第三,它适合生成式媒体产品,但不一定等于“所有 AI 开发都应该用它”。如果你的需求只是单一文本模型调用,或者根本不需要媒体生成与 GPU 基础设施,那它的复杂度可能就超出了实际需要。

对比与选择建议

如果把 Fal.ai 放在相邻类别里比较,它更像“生成式媒体开发平台”,而不是单一模型 API 商。与只卖某一类图像或视频模型的服务相比,它的优势在于模型范围更广、能力更综合;与纯 GPU 租赁平台相比,它的优势又在于开发者不必自己从零搭模型分发和推理入口。也就是说,它位于模型能力与底层算力之间,承担的是更接近平台层的角色。

对第一次评估 Fal.ai 的团队,最务实的方式不是一开始就研究专用集群,而是先做三个动作:首页确认产品定位,Explore 看模型生态,Quick Start 跑一个最小 API 调用,然后再去 Pricing 页判断自己的成本结构是否匹配。如果这三步都能对上你的需求,Fal.ai 就很有可能不是一个“只适合看看”的站点,而是可以进一步纳入正式技术栈的候选平台。

结论

Fal.ai 值得被收录到 AI 开发平台类导航页,因为它把模型发现、统一 API、无服务器推理、GPU 资源、模型部署和企业级扩展组织成了一条完整的开发路径。对于需要接入图像、视频、音频和 3D 生成能力的开发团队,它比单纯的模型目录更接近真实生产需求。第一次访问官网后,最值得优先看的顺序通常是:首页理解定位,Quick Start 跑通上手流程,Explore 评估模型生态,Pricing 核对成本与部署方式,再决定是否继续深度接入。

官方来源

- Homepage: https://fal.ai/

- Docs or quick start: https://fal.ai/docs/documentation/quickstart

- Release or distribution: https://fal.ai/models

- Pricing or licensing: https://fal.ai/pricing

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/fal-ai.html -APPMARK

基于 TypeScript/React 的开源 AI 聊天界面库,内建 Shadcn/UI 和 Tailwind,助您快速构建 AI 对话界面。众多公司和开发者已在使用,提供多种示例和文档。