LTX Video 是由 Lightricks 团队开发并开源的高性能视频生成模型,其核心基于先进的 Diffusion Transformer(DiT)架构与 3D-VAE 变分自编码器技术。该工具旨在为开源社区提供一个高效且可扩展的视频生成框架,能够生成具有高度空间细节和极强时间一致性的视频内容。它支持文本生成视频(T2V)和图像生成视频(I2V),默认分辨率可达 768x512,并能保持 24 帧的高流畅度。由于采用了 Apache 2.0 协议,该模型对商业用途非常友好,允许开发者进行自由修改与二次开发。此外,它深度集成于 Hugging Face 的 Diffusers 库,支持在消费级显卡上运行,是目前开源视频生成领域中技术架构领先、文档完善且极具竞争力的底层框架。

LTX Video是什么?

LTX Video 是由 Lightricks 团队开发并开源的高性能视频生成模型,其核心基于 Diffusion Transformer (DiT) 架构。该项目旨在为开源社区提供一个高效、可扩展的视频生成框架,能够生成具有高度空间细节和时间一致性的视频内容。

技术架构与核心特性

- 模型设计:采用 Latent Diffusion 架构,结合了 3D-VAE(变分自编码器)和 Transformer 骨干网络。3D-VAE 负责在空间和时间维度上对视频进行压缩,显著提升了生成效率。

- 生成能力:支持生成分辨率为 768x512 或 512x768 的视频,标准配置下可生成 24 帧以上的连续画面,并保持良好的动态连贯性。

- 推理优化:模型在设计时考虑了推理成本,支持在消费级 GPU 上运行,并与 Hugging Face 的 Diffusers 库深度集成。

安装与运行流程

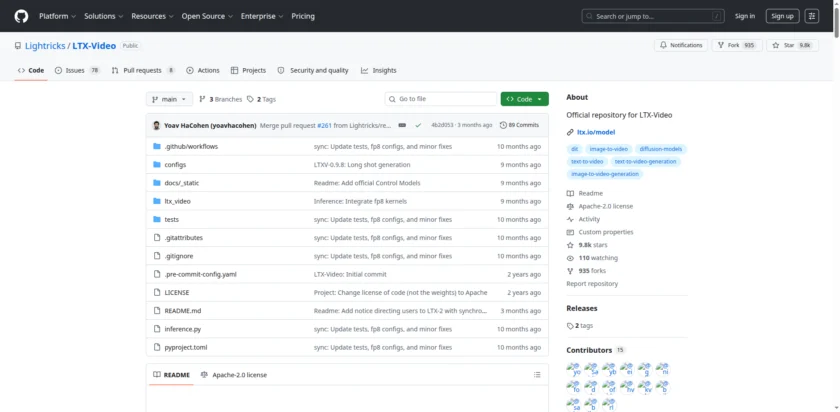

开发者可以通过 GitHub 仓库获取源代码并进行本地部署,主要步骤如下:

- 环境准备:需要 Python 3.10+ 环境,并安装支持 CUDA 的 PyTorch。

- 依赖安装:通过

pip install -r requirements.txt安装必要的库,包括 diffusers、transformers 和 accelerate。 - 权重获取:模型权重托管于 Hugging Face,运行推理脚本时会自动调用或需手动下载至指定目录。

- 执行推理:项目提供了

inference.py示例脚本,用户可以通过命令行输入 Prompt 触发文本到视频(Text-to-Video)的生成任务。

许可版本与适用人群

| 维度 | 详细信息 |

|---|---|

| 开源许可 | 采用 Apache License 2.0 协议,对商业用途友好。 |

| 适用人群 | AI 算法研究员、开源社区开发者、视频创作工具开发者以及需要私有化部署视频生成能力的团队。 |

| 硬件建议 | 推荐使用显存不少于 24GB 的 NVIDIA GPU(如 RTX 3090/4090 或 A100)以实现流畅推理。 |

LTX Video 的开源不仅提供了预训练模型,还开放了完整的训练与推理逻辑,是目前开源视频生成领域中技术架构较为先进、文档相对完善的项目之一。

核心能力与技术结构

技术架构与核心组件

LTX Video 是一款基于潜扩散模型(Latent Diffusion Model)和 Transformer 架构的开源视频生成系统。其核心技术逻辑在于将视频数据在空间和时间维度上进行高度压缩,并在潜空间内通过 Transformer 块进行去噪处理。该模型主要由以下三个关键部分组成:

- 3D 变分自编码器 (VAE): 负责将原始视频像素压缩至低维潜空间,并能高效地将潜信号还原为高保真视频,显著降低了计算开销。

- Diffusion Transformer (DiT): 作为模型的主干网络,利用自注意力机制处理长序列的视频帧,确保了生成内容在时间轴上的连贯性与物理逻辑的合理性。

- T5-XXL 文本编码器: 采用强大的预训练语言模型作为语义理解核心,能够精准解析复杂的提示词(Prompts),实现高度的文生视频对齐。

核心能力指标

| 维度 | 技术规格 |

|---|---|

| 默认分辨率 | 768 x 512 像素(支持多种长宽比调整) |

| 帧率与时长 | 支持 24 FPS 高流畅度视频生成 |

| 模型参数量 | 约 20 亿(2B)参数规模 |

| 生成效率 | 针对消费级显卡进行了推理优化,支持快速迭代 |

安装运行与部署要求

LTX Video 提供了完整的 Python 推理脚本和环境配置指南。开发者可以通过以下步骤快速搭建环境:

- 环境准备: 建议使用 Python 3.10+ 及 PyTorch 2.0 以上版本,并安装

diffusers、transformers和accelerate等核心库。 - 仓库克隆: 通过 Git 获取官方 GitHub 仓库代码并安装依赖项。

- 权重获取: 模型权重已托管于 Hugging Face,运行推理脚本时支持自动下载或手动加载本地权重。

- 硬件建议: 推荐使用显存不少于 24GB 的 NVIDIA GPU(如 RTX 3090/4090),以支持全分辨率的视频推理与生成。

许可版本与适用人群

许可协议: LTX Video 采用 Apache License 2.0 开源协议。这意味着开发者不仅可以免费获取源代码,还可以在遵循协议条款的前提下进行商业化用途、修改和再分发,具有极高的开放度。

适用人群:

- AI 研究员: 用于探索 DiT 架构在视频生成领域的应用边界及微调实验。

- 开源开发者: 基于该模型构建自定义的视频生成工具、插件或集成至现有工作流(如 ComfyUI 节点)。

- 内容创作者: 寻求高自由度、可本地部署的 AI 视频生成方案,以规避云端工具的订阅成本与隐私限制。

安装与运行

技术架构与核心组件

LTX-Video 是由 Lightricks 团队开发的开源视频生成模型,其核心基于 Latent Transformer (LTX) 架构。该项目采用了先进的扩散变压器(Diffusion Transformer, DiT)技术,旨在通过潜空间处理实现高分辨率、高帧率且具有极强时空一致性的视频合成。其技术结构主要包含以下三个关键模块:

- 变分自编码器 (VAE): 负责将原始视频数据压缩至高效的潜空间表示,并在生成阶段将潜信号还原为高质量像素。

- 潜空间变压器 (Latent Transformer): 作为模型的核心,利用 Transformer 的长距离建模能力处理时空张量,确保视频动作的连贯性。

- 条件注入系统: 支持文本提示词(Text-to-Video)及其他模态的引导,通过交叉注意力机制实现精准的内容控制。

环境要求与安装步骤

由于 LTX-Video 涉及大规模参数运算,建议在具备 NVIDIA GPU 的 Linux 或 Windows 环境下运行,显存建议 24GB 以上以支持高分辨率推理。

- 基础环境准备: 确保系统已安装 Python 3.10 或更高版本,并配置好 CUDA 12.1 或 12.4 驱动。

- 克隆代码仓库: 使用 Git 将项目下载至本地:

git clone https://github.com/Lightricks/LTX-Video.git cd LTX-Video - 安装核心依赖: 建议创建 Conda 虚拟环境后执行安装,确保 PyTorch 版本不低于 2.4.0:

pip install -e . pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121 - 模型权重获取: 访问 Hugging Face 官方仓库下载预训练权重文件(如

ltx-video-v1),并将其放置在项目指定的checkpoints目录下。

运行推理

项目提供了标准的推理脚本 inference.py,用户可以通过命令行参数快速启动生成任务。支持自定义分辨率、帧数以及采样步数等关键参数。

python inference.py \

--prompt "A cinematic shot of a dragon flying over a snowy mountain" \

--output_path "result.mp4" \

--num_frames 121 \

--resolution 768x512 \

--guidance_scale 3.0许可版本与适用人群

| 维度 | 详细信息 |

|---|---|

| 开源协议 | 采用 Apache License 2.0 协议,对商业用途和二次开发非常友好。 |

| 适用人群 | AI 算法研究员、开源社区开发者、视频创作工具开发者及技术极客。 |

| 硬件门槛 | 推荐使用 NVIDIA RTX 3090/4090 或 A100/H100 系列显卡。 |

| 主要特性 | 支持变长视频生成、高效的内存管理以及灵活的采样调度。 |

LTX-Video 的发布标志着高效率视频生成模型进入了更加开放的阶段。相比于传统的基于 U-Net 的视频模型,其 Transformer 架构在处理复杂动态场景和长视频序列时表现出更好的扩展性。开发者可以基于该仓库进行微调(Fine-tuning)或集成到现有的 ComfyUI 等工作流中,以实现更具创意的视频生成应用。

许可、版本与社区

许可协议与开源性质

LTX Video 遵循 Apache License 2.0 开源协议。该协议具有极高的开放性,允许个人、研究机构及企业自由地使用、修改和分发代码。开发者在满足保留版权声明及许可说明的前提下,可以将该技术集成到商业产品中,这为 AI 视频生成技术的二次开发和产业化落地提供了法律保障。

版本迭代与核心组件

目前项目处于快速演进阶段,其核心版本信息与技术构成如下:

- 当前版本:主要发布版本为 v0.9,模型权重已同步托管于 Hugging Face 平台。

- 技术架构:采用 Diffusion Transformer (DiT) 架构,专门针对高分辨率视频的时空一致性进行了优化。

- 模型规格:提供预训练的推理模型,支持在不同显存容量的硬件上进行微调或直接生成。

环境要求与安装运行

为了在本地成功部署 LTX Video,建议参考以下技术规格配置环境:

| 类别 | 最低 / 建议要求 |

|---|---|

| 操作系统 | Linux ( 推荐 Ubuntu 22.04) 或 Windows WSL2 |

| Python 环境 | Python 3.10 及以上版本 |

| 核心依赖 | PyTorch 2.0+、Diffusers、Accelerate 库 |

| 硬件配置 | 建议配备 24GB 以上显存的 NVIDIA GPU(如 RTX 3090/4090)以实现流畅推理 |

适用人群与社区生态

LTX Video 的开源生态主要服务于以下群体:

- 算法工程师与研究员:利用开源代码探索视频生成模型的新型训练策略及架构改进。

- 应用开发者:将 LTX Video 作为底层引擎,构建视频编辑、动画制作或广告生成等上层应用工具。

- 创作者社区:通过 ComfyUI 插件或本地脚本,实现高自由度的视频内容生产。

社区支持主要通过 GitHub 的 Issues 和 Discussions 频道进行,开发者可以在此获取最新的补丁说明、提交 Bug 反馈或参与功能提案的讨论。

适合谁?

LTX Video 是由 Lightricks 团队开源的高性能视频生成模型,基于 Diffusion Transformer (DiT) 架构构建。该项目在 GitHub 上遵循 Apache 2.0 协议发布,其代码与模型权重完全公开,允许商业化用途。以下是该工具的核心适用人群及场景:

1. 开发者与系统集成商

- API 与工作流集成: 适合需要将 AI 视频生成能力嵌入自有产品的开发者。LTX Video 已深度集成至 Hugging Face 的

diffusers库,支持通过简洁的 Python 代码实现自动化推理。 - 私有化部署: 针对对数据隐私有严格要求的企业,该项目支持在本地服务器或私有云环境中运行,无需依赖第三方云端 API。

2. AI 研究员与算法工程师

- 架构研究: LTX Video 提供了完整的 3D VAE 和时空 Latent Diffusion 结构,是研究视频压缩技术、长视频生成一致性以及 Transformer 推理效率的理想实验平台。

- 模型微调(Fine-tuning): 适合希望在特定艺术风格、垂直行业数据集上进行 LoRA 微调或全参数训练的技术团队,以获得更具针对性的生成效果。

3. 追求极致性价比的创作者

对于拥有高性能硬件并希望摆脱订阅制费用的个人创作者,LTX Video 提供了极具竞争力的本地运行方案:

| 维度 | 适用性描述 |

|---|---|

| 硬件要求 | 支持 NVIDIA GPU 环境,适合拥有 24GB 显存(如 RTX 3090/4090)的个人工作室。 |

| 许可版本 | Apache 2.0 协议,生成的视频内容版权归属清晰,无商业使用限制。 |

| 技术规格 | 支持 768x512 分辨率及 24fps 帧率,能够生成流畅且具有电影感的短视频素材。 |

4. 开源社区插件开发者

该项目非常适合 ComfyUI 或 WebUI 等开源生态的开发者。由于其结构标准化,开发者可以轻松将其封装为可视化节点,为更广泛的非技术用户提供图形化操作界面,推动开源视频生成生态的发展。

优势与局限

技术架构与许可协议

LTX Video 是由 Lightricks 开发并开源的高性能视频生成模型。其核心采用了 Diffusion Transformer (DiT) 架构,并结合了专门设计的 3D VAE(变分自编码器),能够将视频数据在空间和时间维度上进行高效压缩。该模型在 Apache 2.0 许可协议下发布,这意味着开发者和企业可以自由地进行商业化使用、修改和分发,是目前开源视频生成领域中极具竞争力的方案。

安装与运行环境

模型支持在主流的深度学习框架下运行,推荐配置如下:

- 软件依赖: Python 3.10+、PyTorch 2.4.0+ 以及 Diffusers 库。

- 硬件要求: 建议使用具备 24GB 及以上显存的 NVIDIA GPU(如 RTX 3090/4090),以支持 768x512 分辨率下的流畅推理。

- 部署方式: 官方提供了 Gradio 交互界面和 ComfyUI 节点插件,开发者可以通过以下命令快速集成:

pip install git+https://github.com/Lightricks/LTX-Video.git核心优势

| 维度 | 优势说明 |

|---|---|

| 推理效率 | 得益于 DiT 架构的扩展性,模型在生成 24fps 高帧率视频时具有极低的延迟。 |

| 时空一致性 | 3D VAE 技术有效解决了视频生成中常见的闪烁问题,确保了物体运动的连贯性。 |

| 多模态支持 | 原生支持文本生成视频 (T2V) 和图像生成视频 (I2V),且对长宽比(如 16:9, 9:16)具有良好的自适应能力。 |

| 生态兼容性 | 深度集成于 Hugging Face 生态,支持量化技术(如 bitsandbytes),降低了本地部署的实际门槛。 |

局限性与挑战

- 复杂动作畸变: 在处理大幅度的人体肢体动作或极高动态的场景时,模型仍可能出现物理规律违背或背景扭曲现象。

- 提示词敏感度: 模型对 Prompt 的描述精度要求较高,若提示词过于简略,生成的画面细节可能无法达到预期。

- 显存占用: 尽管支持量化,但在进行长视频序列生成或高分辨率微调时,对显存的瞬时需求依然较高,限制了在低端设备上的表现。

适用人群

LTX Video 主要面向 AI 算法工程师(进行模型微调与二次开发)、创意工作者(利用 ComfyUI 工作流生成素材)以及 开源社区爱好者。对于追求私有化部署、数据安全及商业定制化的企业用户而言,其宽松的 Apache 2.0 协议提供了极高的应用价值。

结论

LTX Video 是由 Lightricks 开发并开源的高性能视频生成模型,其核心基于 Diffusion Transformer (DiT) 架构。该模型通过潜空间扩散技术,在保持高时间一致性的前提下,显著优化了推理效率。作为一款完全开放权重的模型,它为开源社区提供了挑战闭源商业模型的有力工具。

| 维度 | 技术规格与说明 |

|---|---|

| 许可协议 | Apache License 2.0(允许商业用途) |

| 核心架构 | 基于 Transformer 的潜空间扩散模型 (Latent Diffusion) |

| 主要功能 | 支持文本生成视频 (T2V) 与图像生成视频 (I2V) |

| 运行环境 | Python 3.10+、PyTorch、Diffusers 库 |

| 硬件建议 | 推荐使用 24GB VRAM 以上的显卡(如 RTX 3090/4090)以获得最佳推理速度 |

在安装与运行方面,开发者可以直接通过 GitHub 仓库克隆源码,利用项目提供的 requirements.txt 快速配置环境。项目内置了基于 Gradio 的 WebUI 演示界面以及命令行推理脚本,极大降低了本地部署的门槛。此外,由于其深度集成了 Hugging Face 的 Diffusers 生态,开发者可以轻松将其嵌入现有的 AI 工作流中。

适用人群:

- AI 研究员: 用于探索 DiT 架构在视频生成领域的演进与优化。

- 开发者: 基于 Apache 2.0 协议构建自定义的 AI 视频生成应用或插件。

- 内容创作者: 寻求在本地环境实现高自由度、无审查限制的视频素材生产。

总的来说,LTX Video 凭借其卓越的架构设计和宽松的开源许可,成为了目前 AI 视频分类中极具竞争力的底层框架,尤其适合对生成逻辑和本地控制有严格要求的专业用户。

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/ltx-video.html -APPMARK

Runway 始终基于 AI 新技术的前沿,研发视频和图像编辑的全新方法,Runway 拥有 30 多种 AI Magic Tools、实时视频编辑、协作等功能,是下一代媒体内容创作套件。