OpenVINO GenAI LTX 是 OpenVINO 工具套件中针对 LTX-Video 模型的生成式 AI 实现方案。该项目旨在将开源的高质量视频生成模型 LTX-Video 优化并移植到 OpenVINO 运行时,使开发者能够在本地 Intel 硬件(CPU、GPU、NPU)上高效部署文生视频任务,无需依赖云端算力。它基于 OpenVINO GenAI API 构建,通过计算图优化与算子融合,提升视频生成的推理速度。支持模型格式转换、硬件异构计算以及流水线封装,集成了 Text Encoder、Transformer 主干网络及 VAE Decoder 的完整推理流水线,简化了从文本提示词到视频文件的生成流程。该项目遵循 Apache 2.0 开源许可协议,适合希望在 Intel 平台上进行本地 AI 视频生成的开发者及研究人员使用。

OpenVINO GenAI LTX是什么?

OpenVINO GenAI LTX 是 OpenVINO 工具套件中针对 LTX-Video 模型的生成式 AI 实现方案。该项目旨在将开源的高质量视频生成模型 LTX-Video 优化并移植到 OpenVINO 运行时,使开发者能够在本地 Intel 硬件(CPU、GPU、NPU)上高效部署文生视频任务,无需依赖云端算力。

技术架构与原理

该项目基于 OpenVINO GenAI API 构建,通过计算图优化与算子融合,提升视频生成的推理速度。其核心技术路径包括:

- 模型格式转换:利用 OpenVINO 模型转换器,将原始 PyTorch 或 Diffusers 格式的 LTX-Video 模型权重转换为 OpenVINO IR(Intermediate Representation)格式,实现硬件无关的中间表示。

- 硬件异构计算:支持在 Intel 集成显卡、独立显卡及 Arc 系列显卡上运行,通过针对不同架构的内核优化,降低显存占用并提高帧生成效率。

- 流水线封装:集成了 Text Encoder、Transformer 主干网络及 VAE Decoder 的完整推理流水线,简化了从文本提示词到视频文件的生成流程。

安装与运行流程

作为开源仓库项目,其部署遵循标准的 Python 开发环境配置,主要步骤如下:

- 环境构建:创建 Python 虚拟环境,通过 pip 安装

openvino、openvino-genai及相关依赖库。 - 模型导出:使用提供的转换脚本或 Optimum-CLI 工具,将 LTX-Video 模型权重导出为 OpenVINO IR 格式。

- 推理执行:运行示例脚本,输入文本提示词,程序将自动执行推理并保存生成的 MP4 视频文件。

许可协议与适用人群

OpenVINO 工具包主体遵循 Apache 2.0 开源许可协议,商业友好度较高。需注意,具体的 LTX-Video 模型权重可能遵循其独立的开源许可(如非商业许可),使用者需根据实际用途合规使用。

该项目主要适用于以下人群:

- 希望在 Intel 平台上进行本地 AI 视频生成的开发者。

- 需要将文生视频功能集成到边缘计算设备的工程人员。

- 研究生成式 AI 模型优化与推理加速的技术爱好者。

核心能力与技术结构

技术架构概述

OpenVINO GenAI LTX 基于 OpenVINO 工具包构建,是面向生成式 AI 视频领域的完整解决方案。其核心架构分为三层:模型转换层、推理引擎层和高层 API 层。模型转换层负责将 PyTorch、TensorFlow 等框架训练的模型转换为 OpenVINO 中间表示格式;推理引擎层针对 Intel 硬件进行深度优化;高层 API 层则提供简洁的调用接口,降低开发门槛。

核心能力

- 跨平台推理优化:支持 Intel CPU、集成显卡、独立显卡及 NPU 等多种硬件加速,无需修改代码即可在不同设备间切换。

- 模型量化压缩:提供 INT8、INT4 量化工具,显著降低模型体积和内存占用,同时保持生成质量。

- 生成式 AI 专用 API:GenAI 库封装了文本生成、图像生成、视频生成等常用任务的标准化接口。

- 动态形状支持:适应视频生成中可变的输入尺寸和序列长度,无需重新编译模型。

安装与运行

项目采用 Python 包管理方式,安装流程简洁:

- 创建 Python 虚拟环境,推荐 Python 3.8 及以上版本。

- 执行

pip install openvino openvino-genai安装核心依赖。 - 使用

optimum-cli export openvino命令转换 HuggingFace 模型。 - 调用 GenAI API 加载模型并执行推理。

项目同时提供 C++ API,适用于对性能要求更高的生产环境部署。

许可协议与版本

| 项目 | 说明 |

|---|---|

| 开源许可 | Apache License 2.0,允许商业使用和二次开发 |

| 维护状态 | 活跃维护,定期发布更新版本 |

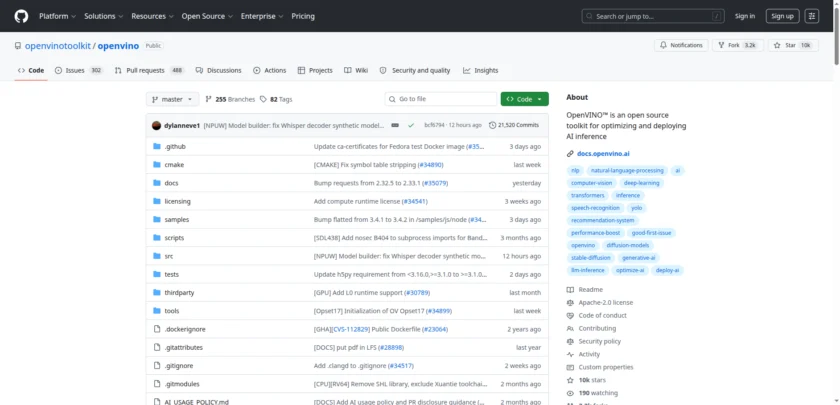

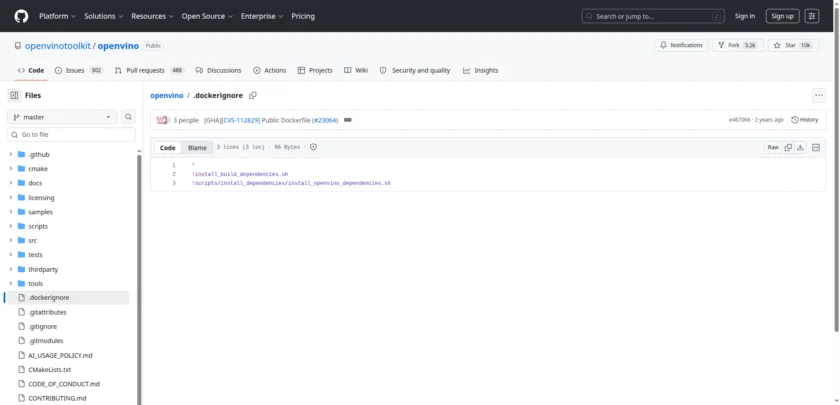

| 代码仓库 | GitHub 托管,提供完整源码和文档 |

适用人群

- 需要在 Intel 硬件上部署生成式 AI 应用的开发者

- 追求推理性能优化与资源效率的工程师

- 构建边缘计算或本地化 AI 视频解决方案的团队

- 希望降低模型部署复杂度的研究人员

安装与运行

OpenVINO GenAI 仓库中的 LTX Video 示例展示了如何利用 OpenVINO 运行时高效执行视频生成任务。该方案通过将模型转换为 OpenVINO 中间表示(IR)格式,实现了在 Intel 硬件上的深度优化与部署。以下内容基于开源仓库视角,详细说明环境搭建、模型转换、推理运行及相关技术细节。

环境配置与依赖安装

在开始安装前,请确保系统环境满足基础要求。OpenVINO GenAI 依赖于 Python 环境进行接口调用,建议使用 Python 3.9 或更高版本。为避免依赖冲突,推荐创建独立的虚拟环境。核心依赖包括 OpenVINO 运行时库、OpenVINO GenAI 扩展库以及用于模型转换的 Optimum Intel 工具包。

执行以下命令完成基础环境的搭建:

python -m venv venv

source venv/bin/activate

pip install openvino-genai optimum[openvino] transformers上述命令将自动拉取 OpenVINO 核心组件、GenAI 高级 API 以及 Hugging Face 接口适配器。由于视频生成模型通常依赖复杂的算子,确保安装正确版本的 PyTorch 作为后端支撑也是必要的步骤。

模型转换与导出

OpenVINO 无法直接运行 PyTorch 原生模型,需将其转换为 OpenVINO IR 格式。仓库利用 Optimum CLI 工具简化了这一过程,支持将 LTX Video 模型从 Hugging Face 格式导出为优化后的 IR 文件。转换过程会将模型的文本编码器、扩散变换器及视频解码器等组件分别序列化。

使用以下命令进行模型转换:

optimum-cli export openvino --model Lightricks/LTX-Video --task text-to-video ./ltx_video_ir转换完成后,指定目录下将生成包含 XML 网络结构与 BIN 权重数据的文件。为了降低显存占用并提升推理速度,用户可在转换阶段添加参数进行 FP16 或 INT8 量化压缩,这在消费级显卡或集成显卡上尤为重要。

推理运行流程

模型导出后,使用 OpenVINO GenAI 提供的高级 API 即可快速启动推理。该 API 封装了复杂的调度器与解码逻辑,开发者仅需编写少量代码即可生成视频。推理过程支持指定设备,包括 CPU、Intel Arc 系列显卡(GPU)以及 NPU。

以下是一个基础的 Python 运行示例:

import openvino_genai

pipe = openvino_genai.Text2VideoPipeline("./ltx_video_ir")

prompt = "A cinematic drone shot of a futuristic city"

video = pipe.generate(prompt, num_frames=65)

video.save("output.mp4")

代码首先加载转换后的 IR 模型目录,随后接收文本提示词并设定生成帧数。通过配置 device 参数,用户可灵活切换推理设备,例如设置为 "GPU" 以利用 Intel Arc 显卡进行加速。

硬件适配与许可说明

OpenVINO 工具包本身基于 Apache 2.0 许可证发布,允许商业与非商业用途。LTX Video 模型的使用权需遵循其原始发布方的许可协议。该工具主要面向需要在本地 Intel 架构上部署 AI 视频生成能力的开发者及研究人员。

不同硬件设备对该推理任务的支持情况如下表所示:

| 硬件类型 | 支持状态 | 推荐配置建议 |

|---|---|---|

| Intel CPU | 完全支持 | 现代多核处理器,AVX2 指令集 |

| Intel Arc GPU | 完全支持 | 建议 8GB 以上显存 |

| Intel NPU | 实验性支持 | Core Ultra 系列处理器 |

许可、版本与社区

开源许可协议

OpenVINO 工具套件核心框架遵循 Apache License 2.0 协议。该协议具有高度的商业友好性,允许用户自由地使用、修改和分发代码,适用于商业闭源产品,仅需保留原始版权及许可声明。

- 框架与运行时:完全开源,无传染性,适合企业级集成。

- 模型权重:LTX-Video 等生成式模型的权重文件通常拥有独立的许可条款,用户在下载和部署前需查阅 Hugging Face 或模型原站的特定授权说明。

版本迭代与获取

项目保持活跃的迭代节奏,OpenVINO GenAI API 作为新一代高层接口,随主版本同步更新。建议使用 2024.0 及以上版本以获得对视频生成模型的完整支持。

| 发布渠道 | 安装命令 | 适用场景 |

|---|---|---|

| PyPI (Python) | pip install openvino-genai |

快速验证、Python 开发环境 |

| Conda | conda install -c conda-forge openvino |

依赖隔离、数据科学工作流 |

| GitHub Releases | 下载预编译包或源码 | C++ 后端部署、深度定制 |

开发者应关注 Release Notes 中的算子支持变更,确保 LTX 模型所需的算子在当前版本已实现优化。

社区生态与支持

作为 Intel 主导的开源项目,OpenVINO 拥有成熟的技术支持体系。社区互动主要集中在 GitHub 仓库,提供问题追踪与功能请求入口。

- 问题反馈:通过 GitHub Issues 提交 Bug 报告,建议附带硬件环境与模型转换日志。

- 代码贡献:社区欢迎 Pull Request,贡献者需签署 CLA 协议,代码风格需遵循项目 C++ 或 Python 规范。

- 学习资源:官方维护 openvino_notebooks 仓库,提供包含 LTX 视频生成在内的交互式示例,是上手 GenAI API 的最佳路径。

适合谁?

本地部署开发者

本项目专为希望在英特尔硬件架构(包括 CPU、集成显卡及 NPU)上部署文生视频模型的开发者设计。仓库提供了完整的 Python 与 C++ 示例代码,支持通过 OpenVINO Runtime 快速构建推理流水线,便于将 LTX-Video 能力集成至现有应用中。

硬件优化与边缘计算研究人员

适合关注模型推理加速与内存优化的技术人员。利用 OpenVINO 的模型优化技术,用户可对 LTX 模型进行权重量化(如 INT8/INT4),显著降低显存占用,从而在消费级设备或边缘端设备上实现高效运行。

隐私敏感型应用构建者

对于数据隐私有严格要求的场景,该方案支持完全离线的本地化推理。无需依赖云端 API,所有生成过程均在本地硬件完成,确保敏感数据不出域,适合金融、医疗或个人隐私项目的开发。

AI 视频技术爱好者

拥有英特尔显卡或处理器的个人用户,可通过本项目低成本体验前沿的文生视频技术。无需昂贵的专业云端算力,仅需按照仓库指引配置环境,即可在本地生成高质量视频内容。

优势与局限

技术架构与性能优势

OpenVINO GenAI LTX 方案的核心优势在于对英特尔硬件生态的深度适配。作为 OpenVINO 工具套件的扩展,该项目利用 OpenVINO Runtime 实现了跨平台推理,支持在 Intel CPU、Arc 系列独立显卡、集成显卡(iGPU)以及 NPU 上运行 LTX-Video 模型。相比原生 PyTorch 环境,该方案通过算子融合与图优化技术,显著提升了推理吞吐量。

- 内存优化机制:支持 INT8 和 INT4 权重量化,大幅降低显存占用,使得在消费级显卡或内存受限的设备上运行高参数量视频模型成为可能。

- 统一 API 接口:提供统一的 Python 和 C++ API,开发者无需深入理解模型底层结构即可调用生成管道,代码迁移成本低,便于集成到现有生产环境。

- 隐私与本地化:完全支持本地离线运行,数据无需上传云端,满足高隐私需求场景,降低了对外部 API 服务的依赖。

局限性与部署挑战

尽管优化显著,该方案在实际应用中仍存在客观局限。首先,模型格式存在依赖壁垒,用户无法直接加载 PyTorch 原生权重,必须使用 optimum-cli 将模型转换为 OpenVINO IR(Intermediate Representation)格式,这一过程需要额外的存储空间与转换时间。

- 硬件绑定特性:推理加速主要针对英特尔硬件架构优化,在 AMD 或 NVIDIA 显卡上的运行效率通常不及原生 CUDA 环境,跨硬件通用性受限。

- 生成延迟问题:视频生成属于计算密集型任务,尽管有量化加速,但在仅使用 CPU 推理时,生成高分辨率长视频的耗时依然较长,难以满足实时交互需求。

- 生态更新滞后:GenAI 库对最新模型架构的支持可能滞后于 HuggingFace Diffusers 社区,部分前沿特性需等待 OpenVINO 更新适配后方可使用。

许可版本与适用人群

该项目遵循 Apache 2.0 开源许可协议,允许商业用途、修改及分发,无传染性限制。其适用人群主要包括:拥有英特尔硬件资源并希望在本地部署 AI 视频能力的开发者;需要在边缘计算设备(如搭载 Intel Core Ultra 处理器的笔记本)上运行生成式 AI 的工程团队;以及对数据隐私有严格要求、无法使用云端 API 的企业用户。

结论

OpenVINO GenAI LTX 方案将 LTX Video 模型的高质量生成能力与 OpenVINO 的推理优化技术深度结合,为 AI 视频领域提供了一套高效的开源解决方案。从技术结构来看,该项目基于 OpenVINO GenAI API 构建,支持将模型转换为 OpenVINO IR 格式,从而在英特尔 CPU、GPU 及 NPU 上实现异构加速推理。

在安装运行层面,开发者需依托 OpenVINO 工具包环境,利用 optimum-cli 完成模型转换,随后通过 Python 或 C++ 接口进行部署。这种方式不仅简化了推理流程,还有效降低了显存占用,提升了模型在边缘设备上的运行效率。

- 许可版本:核心框架遵循 Apache 2.0 开源协议,对商业应用友好,便于企业集成。

- 适用人群:适合需要在本地英特尔硬件上部署视频生成功能的开发者、边缘计算工程师以及关注数据隐私的 AI 研究人员。

该方案为开源社区提供了一条无需依赖昂贵云端算力即可体验高质量视频生成的技术路径,具有较高的实用价值。

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/openvino-genai-ltx.html -APPMARK

腾讯混元文生视频是一个免费在线 AI 视频生成工具,可以根据文本或图像创建高质量的视频,具有真实的运动、专业的镜头工作和无缝的风格转换。