Polycoder 是一个偏研究型的开源代码大模型项目,核心价值不在“做成完整 AI 编程产品”,而在于把一个可公开获取、可复现实验、跨 12 种编程语言训练的代码语言模型带给研究者和开发者。它出自论文《A Systematic Evaluation of Large Language Models of Code》,由 Vincent J. Hellendoorn 等人发布在 Code-LMs 仓库中,并提供了 160M、0.4B 与 2.7B 等多个规模的模型权重。对今天的普通开发者来说,Polycoder 不像 Cursor、GitHub Copilot 那样开箱即用;但如果你关注开源代码模型、代码补全研究、跨语言代码建模,或者希望自己复现实验、做推理与评测,它仍然是一个很有代表性的里程碑项目。

这是什么项目

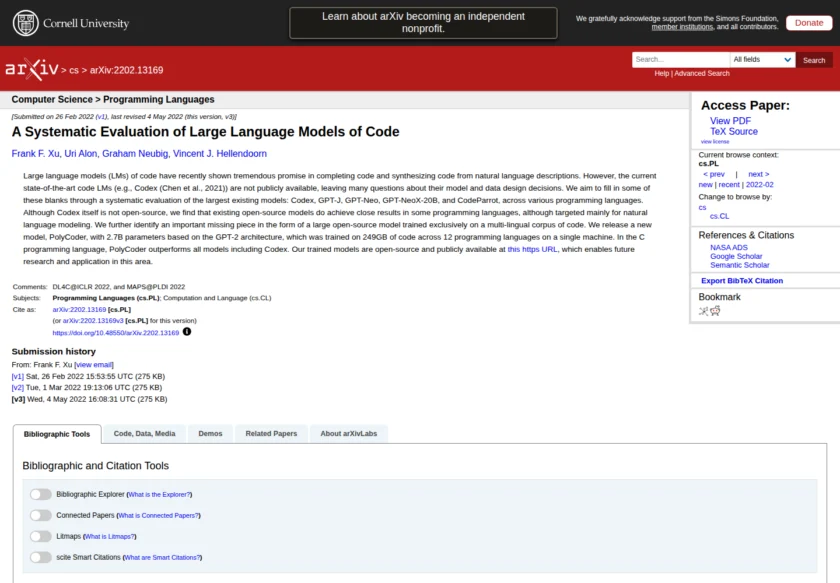

Polycoder 可以理解为一个“公开发布的多语言代码语言模型”家族,而不是面向大众的商业 AI IDE。它最早由论文《A Systematic Evaluation of Large Language Models of Code》提出,论文的目标很明确:在当时 Codex 等最强代码模型尚未公开的背景下,系统比较不同代码大模型的表现,并补上一个关键空白——提供一个真正开源、可下载、可复现实验的多语言代码模型。项目仓库名虽然叫 Code-LMs,但 Polycoder 是其中最知名的公开模型。

从定位上看,Polycoder 更接近研究基础设施。仓库里不仅有模型说明,还有训练数据集描述、权重下载方式、代码生成命令、评测方法以及 HumanEval 与多语言困惑度结果。也就是说,它并不是只放出一份论文附录,而是给出了从“拿到模型”到“运行推理”“复现实验”的完整入口。对研究者而言,这一点非常重要,因为很多代码模型论文会描述结果,却不给可实际使用的权重或复现路径。

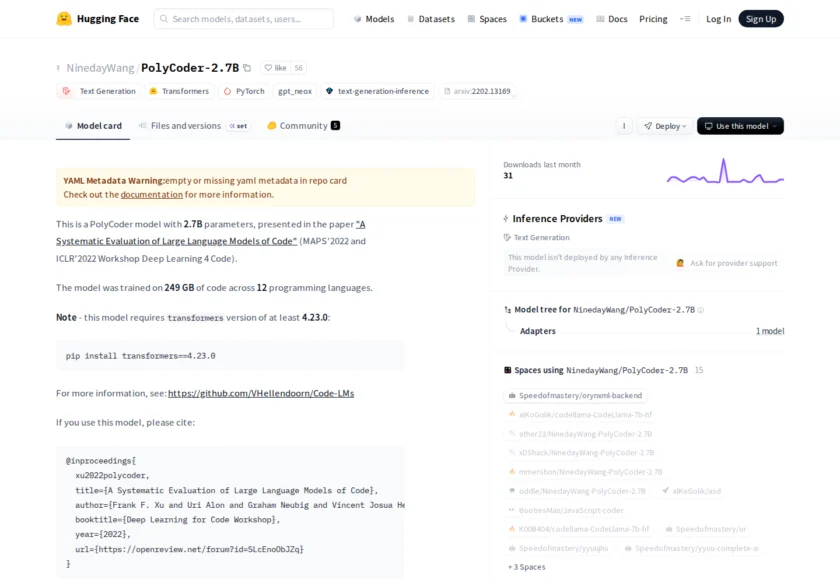

项目公开的核心版本包括 160M、0.4B 和 2.7B 三个量级,其中 2.7B 参数版本就是通常所说的 Polycoder 主模型。仓库 README 说明这些模型使用 GPT-NeoX 工具链训练和推理,并在 2022 年之后由社区贡献者同步到了 Hugging Face,降低了调用门槛。对今天的开发者来说,这意味着你既可以按作者原始流程在本地用检查点和 NeoX 环境运行,也可以直接通过 Transformers 加载 Hugging Face 版本做实验。

因此,如果你把 Polycoder 当成一个“能不能直接帮我写业务代码”的产品,可能会失望;但如果你把它看作“开源代码大模型研究史上一个重要节点”,它的价值就很清楚了:它证明了公开代码模型并不一定只能做小规模试验,也可以训练到 2.7B 参数,并在某些语言上取得很有竞争力的结果。

技术架构与核心能力

Polycoder 的一个关键特点是“只在代码语料上训练”。README 与论文摘要都明确提到,它是基于 GPT-2 架构的 2.7B 参数模型,并训练于一个跨 12 种编程语言、总量约 249GB 的代码语料库。这一点和很多同时混合自然语言、网页文本、文档说明的大模型不同。Polycoder 主要从代码本身以及代码注释中学习模式,因此它在纯代码续写、语言建模与特定编程语言结构建模上具有鲜明特征。

训练数据覆盖 C、C#、C++、Go、Java、JavaScript、PHP、Python、Ruby、Rust、Scala、TypeScript 共 12 种语言。根据仓库公开统计,原始抓取语料来自 GitHub 上热门仓库,先经过大小与长度过滤,再按内容哈希去重,最后留下约 24.1M 个文件、249GB 数据。与只偏向 Python 或 JavaScript 的代码模型相比,这种数据构成让 Polycoder 更适合做跨语言研究,也让它在一些传统系统语言上表现突出。

README 中最值得注意的一条事实,是作者明确写出:在 C 语言上,Polycoder 的结果优于当时比较的所有模型,包括 Codex。论文摘要也保留了这一结论。这并不代表它在所有任务上都全面领先,更不意味着它能替代今天更新一代的编程助手;但它说明了一个研究结论:针对代码做更专门的训练、使用更多 C 语料,确实可能在某些语言和场景中胜过更通用的大模型。

项目还公开了 HumanEval 结果。README 显示,2.7B 版本的 PolyCoder 在 HumanEval 上的 Pass@1 为 5.59%,Pass@10 为 9.87%,Pass@100 为 17.68%。这个成绩放到今天当然不算前沿,但在它发布的时间点,作为完全公开、可复现的开源代码模型,它已经具备了明确的研究和比较价值。更重要的是,项目没有只展示一个漂亮 demo,而是把局限也写得很坦白:它并非专门为自然语言编程题训练,对 HumanEval 这种基于自然语言提示的任务未必最强。

除此之外,仓库还给出模型配置细节,例如 2.7B 版本是 32 层、2560 维 Transformer,训练使用 4 到 8 张 NVIDIA RTX 8000 GPU;较小模型则分别对应 0.4B 与 160M 规格。这些信息对于研究者选择复现实验成本、理解模型规模与性能关系非常有帮助,也说明项目的透明度相对较高。

安装与使用

Polycoder 的使用方式大致分成两类。第一类是沿用作者在仓库里提供的原始路线:从 Zenodo 下载检查点,把文件放进 checkpoints/ 目录,再通过作者维护的 GPT-NeoX 分支或 Docker 镜像运行推理与评测。README 里给出了从下载、解压到生成代码的命令示例,适合需要严格复现实验环境的人。它也明确提醒,2.7B 检查点最高会占用约 6GB 文件体积,并且大致也需要相近量级的显存来运行,CPU 推理“未测试且不推荐”。

第二类方式更适合今天的开发者:直接使用 Hugging Face 上的社区转换版本。仓库 README 和 Hugging Face 模型卡都指出,目前可以通过 NinedayWang/PolyCoder-160M、NinedayWang/PolyCoder-0.4B、NinedayWang/PolyCoder-2.7B 三个仓库,用 Transformers 4.23.0 及以上版本加载 tokenizer 和模型。这显著降低了实验门槛,不必先研究 NeoX 配置文件,也不必自己做格式转换。

在实际输入上,Polycoder 更适合“给出已有代码上下文,然后让它继续补全”,而不是像聊天式编程助手那样通过长篇自然语言来一步步协作。README 还特别强调空白字符和缩进非常重要,因为训练数据没有做激进预处理,模型会把整份文件、包括换行、缩进与注释一起当作信号。也就是说,如果你给它的上下文缩进不合理、文件结构不自然,输出质量会明显下降。

对于研究型使用者,一条比较稳妥的路径是:先用 Hugging Face 版本跑通小样本补全;确认任务风格后,再决定是否使用原始权重和评测脚本做更严格实验。如果你想做代码补全 benchmark、跨语言比较、代码语言建模或模型蒸馏,这个项目仍然有参考价值。如果你的目标只是写业务代码或在 IDE 里获得即时助手体验,那么它的上手成本和交互方式都不算友好。

从工程可用性角度看,Polycoder 更像一个“原料”而不是“成品”。你可以把它接进自己的推理脚本、做离线实验、用于教学或论文比较;但仓库并没有提供完整 IDE 插件、团队协作、会话管理、自动修复、仓库理解等现代 AI 编程产品常见能力。是否值得用,取决于你究竟是在做研究,还是在追求生产效率。

价格与开源状态

Polycoder 的最大卖点之一,就是它的公开可获取性。论文与仓库都把“open-source and publicly available”作为关键结论之一。模型检查点可以从 Zenodo 获取,仓库代码、数据构建说明、评测流程也都公开在 GitHub 上,社区还额外提供了 Hugging Face 版本,便于直接推理。对研究者而言,这种公开性远比单纯给一个在线 demo 更重要,因为它意味着可复核、可比较、可二次开发。

不过也要区分“开源可得”与“商业产品免费”。Polycoder 本身不是 SaaS,也没有独立订阅价格页,因此不存在典型意义上的套餐费用;但你需要自行承担运行成本,例如显卡、存储、环境配置与实验时间。如果使用 Hugging Face 下载模型做本地推理,成本主要是算力与运维;如果只阅读论文和结果,当然几乎没有门槛。

从许可证与使用约束角度,仓库更偏学术公开项目,而不是围绕企业落地设计的产品方案。对于个人研究、课程教学、基准比较、模型分析,这种形态非常合适;但如果企业要把它直接接进生产环境,还需要自行评估维护成本、推理效果、安全策略以及与现代编程助手相比的差距。

适合谁

Polycoder 最适合三类人。第一类是做代码大模型研究的人,包括 ML for Code、代码补全、程序理解、跨语言模型比较等方向的研究者。因为它公开了模型、数据规模、训练流程和评测结果,天然适合做论文对比与复现实验。

第二类是高校教师、学生和技术写作者。很多现代代码模型虽然能力强,但闭源、接口多变、成本不稳定,不适合教学演示。Polycoder 这样的公开项目更便于说明“代码语言模型是怎么训练的、如何评测、为什么不同语言表现不同”。

第三类是有较强动手能力的开发者或开源爱好者。如果你想研究一个较早期但完整公开的代码模型案例,或者想把模型接入自己的离线实验脚本中,Polycoder 仍然值得尝试。但如果你期待的是像 Copilot、Cursor、Claude Code 那样的即用型开发体验,它并不是优先选择。

优势与限制

Polycoder 的优势首先是公开透明。很多代码模型项目只公开论文,不公开权重;或者只开放 API,不开放训练与评测细节。Polycoder 则把模型规格、数据集统计、权重下载、推理命令、评测结果都摆在明面上,这让它在研究语境里非常有价值。第二个优势是多语言覆盖广,12 种语言使它不至于局限在单一生态。第三个优势是它在 C 语言上的突出表现,这一点在代码模型研究中具有代表性。

它的限制同样明显。第一,模型发布时间较早,能力边界已经被后续更大、更强、更产品化的代码模型拉开差距。第二,它不以自然语言交互为中心,HumanEval 表现也说明它在“根据自然语言题意直接写完整函数”这类任务上并不是强项。第三,项目更像研究材料而非成品工具,缺少 IDE 插件、项目级理解、智能修复、Agent 工作流等现代 AI 编程体验。

README 还坦率指出了一些技术 caveat:模型可能在预测到文件结尾后开始生成随机新文件;由于训练时几乎保留了完整原始格式,空白字符和缩进对输出影响很大;而且它主要从代码及注释中学习,并不是针对编程题问答专门优化。换句话说,Polycoder 的最佳使用方式不是把它神化为“万能写码模型”,而是把它放回自己的历史与研究定位中理解。

同类项目对比

如果把 Polycoder 和 GitHub Copilot、Cursor、Claude Code 这类当代 AI 编程工具相比,它显然不是一个维度的产品:后者强调实际开发效率、IDE 集成、代理式操作、聊天交互和工程化体验;Polycoder 强调的是“公开代码模型本身”。因此对于普通软件团队,Polycoder 不太可能成为首选生产工具。

如果把它和同样公开的代码模型相比,例如早期 GPT-Neo、CodeParrot、StarCoder 一类,Polycoder 的特色在于更专门地针对多语言代码训练,并且在 C 语言上拿到很强结果。README 里的 HumanEval 结果也显示,它整体仍落后于 Codex 和更大的通用模型,但在公开研究语境中,它补上了“开放、可验证、跨语言”的那块拼图。

所以选择建议很简单:要生产力,选现代 AI 编程产品;要研究基线、公开权重、多语言代码建模案例,Polycoder 依然有学习和使用价值。它更像一块研究样本石,而不是一把今天最锋利的工程瑞士军刀。

结论

Polycoder 并不是今天最强的 AI 编程助手,但它仍然是开源代码大模型发展中的一个重要节点。它把 2.7B 级别、多语言代码训练、公开权重、可复现实验和完整评测放在一起,给研究社区提供了一个可以真正下载、运行、比较和继承的基础项目。对于需要即用型效率工具的人,它不够现代;对于希望理解代码大模型如何训练、如何评估、为何不同语言表现差异明显的人,它依然值得读、值得跑、也值得放进资料库。

官方来源

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/polycoder.html -APPMARK

面向 GitHub 与 GitLab 团队的 AI 代码审查平台,强调全仓库上下文理解、自动 PR 评论、团队偏好学习和云端/自托管双路线部署。