vLLM 是一个面向大语言模型推理与服务部署的开源引擎,核心目标不是训练模型,而是让已经训练好的开源模型在真实生产环境里跑得更快、更省显存、更容易接入业务系统。它最早由 UC Berkeley 的 Sky Computing Lab 发起,后来发展成社区驱动项目,并逐步成为开源大模型推理栈里非常常见的一层。很多团队会把 Hugging Face 模型下载下来,但真正把模型稳定部署成 API、跑出高吞吐、处理多并发请求、控制 GPU 占用时,往往会发现“能跑”和“跑得好”之间有一条很深的工程鸿沟。vLLM 解决的正是这类问题。

这是什么产品

从定位上看,vLLM 更接近“LLM 推理运行时 + 服务层”,而不是聊天产品、训练平台或纯研究代码。官方把它描述为高吞吐、内存高效的 LLM inference and serving engine,强调部署与服务能力。也就是说,如果你已经有 Llama、Qwen、Mistral、DeepSeek、Embedding 模型或多模态模型,vLLM 的任务是把这些模型变成更适合线上调用的推理服务。

它之所以受到关注,关键不在于界面,而在于底层机制。传统推理方式在多请求并发时,经常会被 KV Cache 占用、显存碎片、批处理效率低等问题拖慢。vLLM 通过 PagedAttention、连续批处理、前缀缓存、量化支持和多种并行能力,把 GPU 利用率做得更高,让同样的硬件跑出更多 token 吞吐。这也是为什么它常被放进企业自建推理栈、开源模型 API 平台和推理网关方案里。

核心功能与工作流

vLLM 的核心能力可以拆成几层。第一层是推理加速层。项目最有代表性的技术点是 PagedAttention,它通过更高效的 KV Cache 内存管理方式,降低显存浪费,让长上下文和多请求并发时的资源利用率更好。官方文档与论文都把这件事当作 vLLM 的招牌能力,因为很多推理瓶颈本质上都是缓存管理问题,而不只是算力问题。

第二层是服务能力层。vLLM 提供 OpenAI-compatible API server,这一点对工程团队非常重要。很多现有应用、Agent、工作流平台和前端只认 OpenAI 接口格式,如果部署一个模型后还要重写大量接入代码,迁移成本就会上升。vLLM 把这件事做成了兼容接口,因此团队可以用更低成本把开源模型接到原有系统里。

第三层是部署扩展层。文档明确提到它支持张量并行、流水线并行、数据并行以及专家并行,适合单卡、本地多卡到分布式集群的不同规模。除此之外,它还支持 speculative decoding、chunked prefill、streaming outputs、prefix caching、Multi-LoRA,以及 GPTQ、AWQ、INT4、INT8、FP8 等量化路线。这说明 vLLM 不只是一个“把模型跑起来”的简单包装,而是已经形成了相对完整的推理工程工具箱。

典型工作流通常是:先选择受支持的开源模型;然后通过 pip、uv 或 Docker 安装 vLLM;接着用命令行或 Python API 启动服务;最后通过 OpenAI 兼容接口把模型接入应用。对于需要多租户、不同模型混布或 LoRA 组合推理的团队,则会进一步使用它的并发调度和扩展能力,把它放到正式 API 网关或 K8s 集群后面。

如何开始使用

vLLM 的上手路径相对清晰。官网首页直接给出 Quick Start,并提供 Stable 与 Nightly、CUDA/ROCm/XPU/CPU、Python 或 Docker 等安装选项。对多数开发者来说,最快的起点就是安装 Python 包,然后使用官方 Quickstart 跑一个受支持模型。文档还把不同读者分流得很明确:想运行开源模型可以从 Quickstart 开始,想构建应用看 User Guide,想参与开发则看 Developer Guide。

如果你的目标是自建一个兼容 OpenAI SDK 的模型服务,vLLM 的起步门槛比从零拼装推理栈低不少。你不需要先造一层 API 适配器,只要根据文档启动 OpenAI 兼容服务器,就能直接让上层应用发起 chat/completions 风格请求。对于已经在使用 LangChain、LlamaIndex、Dify、Flowise 或自家内部网关的团队,这一点很省时间。

不过,上手容易不代表部署没有门槛。要把 vLLM 真正用好,还是需要理解模型显存需求、量化策略、并发参数、上下文长度、GPU 类型和吞吐目标之间的关系。如果只是个人本地实验,默认参数往往够用;但如果要做企业级服务,最好结合模型大小、SLA 和硬件成本做压测。vLLM 本身提供了很强的底座,真正决定效果的往往是部署参数和模型选择。

价格与开源状态

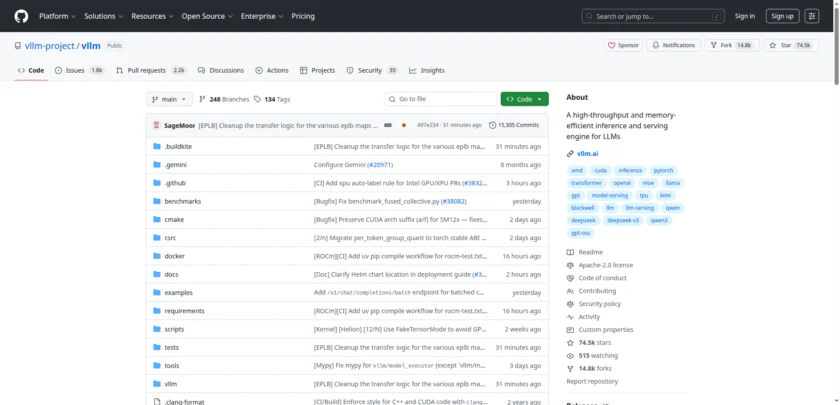

vLLM 本体是开源项目,GitHub 仓库采用 Apache-2.0 许可证,这对商业使用非常友好。对于企业和创业团队来说,Apache-2.0 的意义很实际:可以在自建平台、商业 SaaS 或内部模型服务中使用,而不像某些更严格许可证那样限制较多。官方站点没有把 vLLM 包装成标准 SaaS 收费产品,首页反而更强调社区、赞助者与计算资源支持,说明它的核心交付形态仍然是开源软件,而不是闭源云服务。

这也意味着它的“价格”并不是按 seat 或月费来计算,而更多体现在硬件、运维、工程投入和云资源账单上。换句话说,vLLM 本身免费,但要跑模型仍然要付 GPU 成本、带宽成本和集群管理成本。对不少团队来说,这种成本结构反而更灵活:你不被单一推理服务商锁死,可以按自己的模型、云厂商和机器类型来做优化。

适合谁

vLLM 最适合三类人。第一类是需要部署开源大模型 API 的工程团队,例如做企业内部问答、智能体后端、行业模型接入或模型中台的人。第二类是模型平台与基础设施团队,他们需要在成本、吞吐、延迟和兼容性之间取得平衡,希望把一套开源模型服务得更接近商业 API 的体验。第三类是研究与产品混合团队:既想快速验证模型能力,又不希望被现成托管服务的成本和限制束缚。

它不太适合的场景也很明确。如果你完全不打算自己部署模型,只想直接调用现成闭源 API,那么 vLLM 不是必须品;如果你做的是模型训练、数据标注或低代码工作流搭建,它也不是核心工具。vLLM 真正擅长的是“推理与服务”这一段,尤其是把模型稳定、高效地暴露成接口。

优势与限制

vLLM 的优势非常鲜明。第一,性能导向明确。PagedAttention、连续批处理、量化、并行和前缀缓存这些能力都直接服务于吞吐和资源效率。第二,生态接入友好。它支持大量 Hugging Face 开源模型,又提供 OpenAI 兼容 API,这让上下游对接阻力小很多。第三,社区活跃度高。官方文档、论坛、Slack、博客、论文和 GitHub release 都比较完整,说明它已经不是一个停留在论文阶段的小项目,而是持续演进的开源基础设施。

限制也不能忽略。首先,它主要解决推理问题,不负责帮你挑模型、清洗数据或自动完成完整应用开发。其次,不同硬件、不同模型、不同并行策略的最佳实践并不统一,想把性能跑满仍然需要工程经验。再者,虽然 OpenAI 兼容接口大大降低了接入门槛,但一旦涉及多模型编排、权限、计费、审计、网关和多租户隔离,企业通常还要在 vLLM 之上再叠加一层平台能力。也就是说,vLLM 是一个很强的引擎,但并不是整个生产系统的全部。

对比与选择

如果把 vLLM 放在同类工具里比较,它更像推理引擎,而不是完整 AI 应用平台。和直接使用 Hugging Face Transformers 本地推理相比,vLLM 更偏生产部署、并发吞吐与服务能力;和 Ollama 这类更偏本地使用体验的工具相比,vLLM 更适合服务端与集群化场景;和商用托管推理平台相比,vLLM 的优势是开放、可控、便于自定义,代价则是你要自己承担更多部署和运维工作。

因此,是否选择 vLLM,核心要看你要解决的问题是什么。如果你的问题是“我想低成本把开源模型快速接成 API,并且尽量跑得高效”,vLLM 非常值得优先评估;如果你的问题是“我想要一个带权限、工作流、数据管理和运营后台的一站式平台”,那你可能还需要把 vLLM 与其他平台工具组合使用。

结论

vLLM 是当下开源 LLM 推理与服务领域里非常关键的一块基础设施。它的价值不在于包装成一个炫目的终端产品,而在于把部署开源模型这件事做得更快、更省、更接近生产可用。对于需要自建模型服务、优化 GPU 成本、保留架构自主权的团队来说,它是很值得长期关注和投入的一层。如果你正准备从“调用第三方模型 API”走向“自己掌控开源模型推理栈”,vLLM 基本属于绕不开的工具。

官方来源

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/vllm.html -APPMARK

无需编码,轻松创建强大的 AI 工具,访问 16+ 模型,节省时间和成本,白标定制,团队协作,面向非技术型企业主。