ChatDev 是 OpenBMB 开源的多智能体开发平台。它最早因“让 CEO、CTO、程序员、测试等角色协作完成软件开发”而出圈,到了 2.0 阶段又进一步演化成 DevAll:一个更通用的零代码多智能体编排平台。对 AI 导航站读者来说,ChatDev 的价值不在于做一个会聊天的壳,而在于它把“多代理如何分工、如何串联工作流、如何从配置直接跑起来”做成了可以复用、可以扩展、也可以本地部署的工程化产品。

这是什么产品

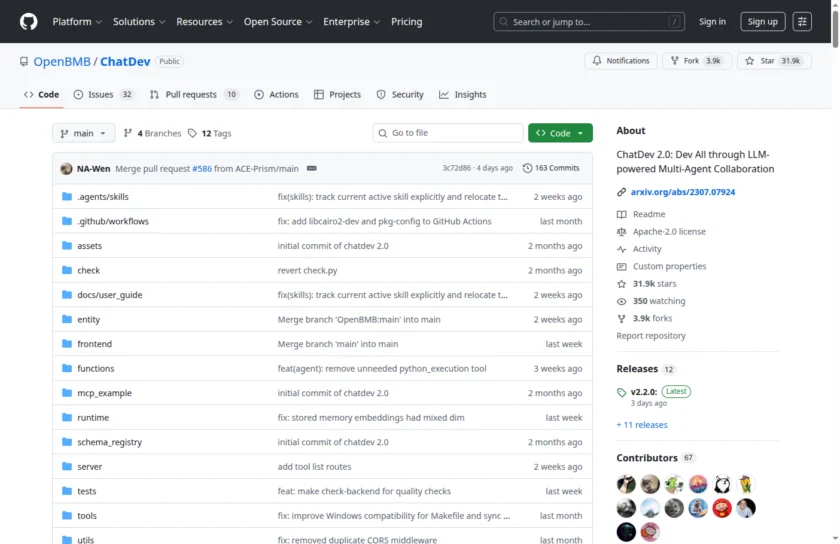

从官方 GitHub 首页可以直接看出,ChatDev 现在的核心定位已经不再只是“自动写软件的实验项目”,而是一个面向更广泛任务场景的多智能体协作平台。仓库标题明确写着 “ChatDev 2.0: Dev All through LLM-powered Multi-Agent Collaboration”,README 首屏进一步把它定义为 “A Zero-Code Multi-Agent Platform for Developing Everything”。这说明官方叙事已经从早期软件公司模拟器,扩展为面向多种复杂任务的智能体编排底座。

官方同时保留了两个清晰的产品层次。其一是 ChatDev 2.0 / DevAll:强调通过简单配置就能搭建 agent、workflow 与 task,不要求用户先写大量业务代码;其二是 ChatDev 1.0 Legacy:即那个以虚拟软件公司为结构、让 CEO、CTO、Programmer、Reviewer 等角色围绕需求展开讨论并交付软件的经典版本。对初次接触这个项目的人来说,这个区分很重要,因为你会发现它既有研究范式价值,也有平台化产品价值。

从产品属性看,ChatDev 更接近“多智能体运行与编排平台”而不是单点模型应用。它并不只回答一个问题,而是让多个角色、多个节点、多个阶段按照既定工作流协作完成任务。官方材料提到的数据可视化、3D 生成、Deep Research、Game Dev 等案例,说明它尝试承载的不是单一场景,而是一类可以由多步骤、多角色共同推进的复杂任务。

如果你关注 Agent 基础设施或者 AI 工作流产品,ChatDev 值得看的地方就在这里:它把“角色协作”“流程拆分”“上下文流转”“工具调用”“结果落地”这些抽象能力,做成了一个可以本地启动、可视化操作、也可通过 Python SDK 编程调用的项目。相较于只给你一个聊天入口的 AI 工具,ChatDev 更像是给你一套可搭建团队协作代理系统的工作台。

核心能力与工作流

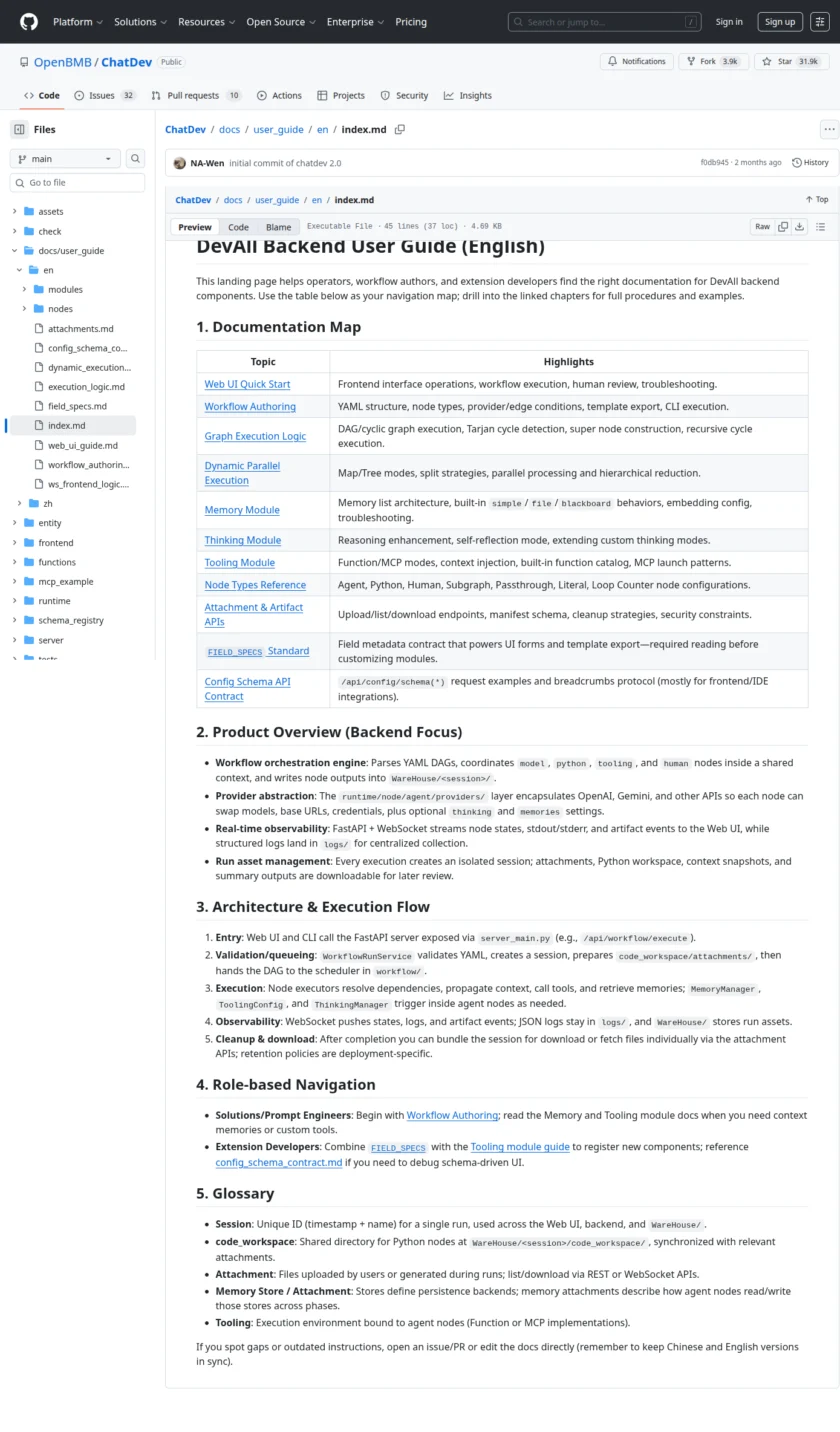

ChatDev 的核心能力可以概括为三层。第一层是多智能体协作抽象:它允许用户定义不同 agent 的职责、提示词、上下文流向与执行节点,把一个复杂任务拆成多个可控阶段。第二层是工作流编排:官方在 2.0 中突出强调 workflow、launch、tutorial 等界面和概念,说明它不仅想让用户“看见多个 agent”,更想让用户能够真正设计、同步、运行和调试这些 agent 之间的协作链路。第三层则是工程化交付能力,包括本地前后端、YAML 工作流、Python SDK、Docker Compose 与可扩展模块。

在官方 README 里,DevAll 的典型用法并不是空泛的“帮我做点事”,而是围绕具体任务模板展开。仓库公开列出了数据可视化、3D 生成、游戏开发、深度研究、教学视频等示例工作流,用户可以在 Launch 标签中选择 workflow、上传必要文件、输入 prompt,然后执行并查看结果。这种设计说明 ChatDev 的重点是“让任务流程有结构地跑起来”,而不是把所有能力都塞进一个对话框里。

另一条非常关键的线索是它对扩展性的强调。官方把项目结构拆成 server、runtime、workflow、entity、frontend、functions 等模块,还专门给出二次开发和扩展入口。这意味着 ChatDev 并不只是一个演示用研究原型,而是希望开发者继续向里面添加节点、模型提供商、工具函数与自定义工作流。对于团队用户或高级玩家来说,这一点决定了它是否能真正进入生产前的试验环境。

从经典 ChatDev 1.x 的角度看,它最有辨识度的地方依然是“虚拟软件公司”范式:不同角色围绕需求开会、设计、编码、测试、文档化,形成一种通信驱动的协作链。即便 2.0 已经把产品扩展到了更广泛的多智能体编排平台,1.x 仍然提供了理解 ChatDev 思路的最好入口:它相信复杂任务可以被角色分工和沟通协议显著改善,而不是只靠单模型一次性生成结果。

如何开始使用

如果按照官方当前的 2.0 路线来上手,最直接的方式是先按 README 启动本地环境。公开说明里给出的基础依赖包括 Python 3.12+、Node.js 18+ 与 uv;后端依赖通过 uv sync 安装,前端则在 frontend 目录执行 npm install。之后复制 .env.example 为 .env,把所需模型的 API Key 与 Base URL 填进去,再用 make dev 同时启动前后端,最后从浏览器访问本地 Web Console。对于熟悉开发环境的人来说,这个流程并不复杂,但它明显不是“点开即用”的轻量 SaaS,而更像一个需要本地准备环境的开发者产品。

官方还给了另一条更稳定的运行路径:Docker Compose。对于不想手动处理前后端依赖的人,可以在准备好 .env 之后直接使用 docker compose up --build。这说明 ChatDev 团队在产品化上考虑到了两类用户:一类是希望直接读源码、改模块、开本地调试的开发者;另一类是更在意可复现环境、想先跑起来看结果的使用者。能同时提供这两种入口,是它比很多只有论文代码的项目更成熟的地方。

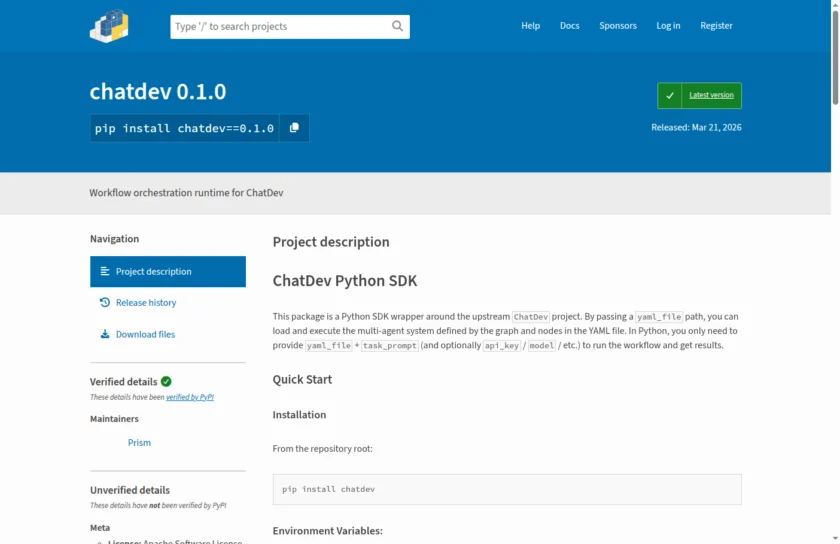

如果你只想把 ChatDev 作为能力底座集成进自己的 Python 项目,也可以走官方 Python SDK 路线。PyPI 的 chatdev 0.1.0 页面说明,用户可以通过 pip install chatdev 安装 SDK,再调用 run_workflow() 传入 YAML workflow、task prompt 与可选配置,在代码里直接执行多智能体流程并获取结果。 GitHub Releases 页面也提供了另一种公开分发与版本追踪入口,便于观察项目是否持续迭代。这使得 ChatDev 不只是一个网页控制台,也是一套可嵌入其他系统的 runtime。

从学习成本看,我更建议第一次接触时按“README 首次启动 → 文档索引页 → 官方示例 workflow”这个顺序走。先确认本地能跑通,再去看 workflow authoring 与模块说明,最后再尝试修改 YAML 或接入自己的任务。这样会比一上来就研究完整源码结构更有效,也更符合官方给出的入门层级。

uv sync

cd frontend && npm install

cp .env.example .env

make dev

价格、开源状态与部署方式

截至当前公开官方页面,ChatDev 没有给出面向普通用户的 SaaS 价格表,主要公开形态仍然是开源项目与开发平台。GitHub 仓库明确提供源码、README、文档与 Docker 运行方式;PyPI 页面则给出 Python SDK 分发;PyPI classifier 显示其采用 Apache Software License。换句话说,ChatDev 当前更像“开源可部署 + SDK 可集成”的平台,而不是一款按座席收费的商业 AI 助手。

部署方式方面,至少可以确认三条路线。第一条是标准本地开发部署:后端 Python、前端 Vue/Vite,适合需要看源码、改逻辑和本地调试的开发者。第二条是 Docker Compose,适合更快搭环境和保持一致性。第三条是 Python SDK 集成,适合把既有 YAML workflow 直接嵌入脚本或更大系统中调用。对于研究团队、智能体工程师或做原型验证的团队来说,这三条路线分别覆盖了实验、演示和系统集成三种需求。

同时也要明确它的边界。ChatDev 虽然在 README 中提到“Zero-Code”,但这更多指多智能体系统可通过配置方式搭建,而不是完全没有技术门槛。你仍然需要理解模型配置、环境变量、工作流结构、节点职责与运行依赖;如果要做二次开发,还要读 server、runtime、workflow 等模块。这意味着它更适合具备一定技术背景的用户,而不是纯非技术型办公人群。

另一个现实问题是模型与运行成本。项目本身开源不代表使用成本为零。只要 workflow 里调用商业大模型、长链路推理或多代理协作,就会消耗 API token、算力和调试时间。尤其在复杂任务下,多智能体架构带来的收益和开销都比单轮对话更明显,因此实际部署前最好先用官方 demo workflow 小规模验证,不要一上来就用高成本模型跑长流程生产任务。

适合哪些人和场景

ChatDev 最适合三类人。第一类是研究者和 AI Agent 开发者,他们关心的不是一个现成问答机器人,而是多智能体如何编排、如何演化、如何协作完成复杂任务。对这类人来说,ChatDev 的学术渊源、角色式协作结构和公开工作流模板,都有很高的参考价值。第二类是想做内部原型或 PoC 的工程团队,他们需要一个已经把前后端、runtime、workflow 与 SDK 整合好的底座,以便快速验证业务流程是否适合用多代理去做。

第三类则是愿意投入一定学习成本、想把复杂任务流程产品化的高级用户。比如做数据分析自动化、深度研究、内容生产流水线、小游戏生成或其他多步骤任务的人,ChatDev 提供的 YAML workflow、节点扩展与 Launch 控制台,能够帮助他们把“一个好主意”逐步变成“一个可复跑的代理流程”。这和单次 prompt 工程相比,最大差异在于它更关注稳定的流程设计,而不是一次回答的灵光一现。

反过来看,如果你只是想找一个开箱即用的日常 AI 助手,ChatDev 未必是最省力的选择。它不是聊天入口优先的产品,也没有把一切复杂性都藏起来。它的优势来自结构化、多角色、可扩展,但这也决定了它更适合需要“搭系统”的人,而不是只想“拿结果”的轻量用户。

优势与限制

ChatDev 的第一大优势是产品形态完整。很多开源 agent 项目要么只有论文思路,要么只有一段演示视频;ChatDev 则同时给出了仓库、文档、前后端控制台、Docker 路线、Python SDK 和可运行 workflow,这让它从研究原型更接近一个真正能拿来试验和扩展的平台。第二个优势是叙事清晰:1.x 的虚拟软件公司范式非常容易理解,2.0 的 DevAll 又把这个思路推广到更广的任务类别,读者能够看见项目如何从一个爆款概念走向更通用的编排平台。

第三个优势是工程可扩展性。官方公开的模块结构和 workflow 体系意味着你可以不仅“用它”,还可以“改它”“接它”甚至把它嵌进自己的系统。对做 agent infra 或工作流平台的人来说,这种开放度很有价值。再加上 PyPI SDK 的存在,说明团队也在降低程序化集成门槛,而不是强制所有人都只能通过 Web 控制台使用。

它的限制同样明显。首先,真正跑起来并不轻。你需要准备 Python、Node、前端依赖、模型密钥和环境变量,还要理解各类工作流配置。其次,多智能体系统天然比单代理或单模型应用更难调试,流程越长、角色越多,排错与成本管理越重要。再次,README 中展示的案例很丰富,但“适合展示”不等于“适合生产”,很多场景仍然需要你自己做提示词、工具、权限与异常处理层面的工程补强。

因此更准确的评价是:ChatDev 很强,但它强在“给你搭系统的能力”,不是“替你省掉全部工程复杂度”。如果你愿意投入学习和调试,它会是一个很有深度的多智能体底座;如果你追求的是零配置、零维护、拿来即用,那么你可能会觉得它门槛偏高。

对比与选择建议

把 ChatDev 放到同类产品里看,它既不像普通 AI 办公助手,也不同于只面向开发者的轻量 agent SDK。它更像站在两者之间:既保留了开发平台与工作流系统的工程属性,又努力通过可视化控制台和 YAML workflow 降低多智能体搭建门槛。与很多“单 agent + tools”框架相比,ChatDev 更强调角色协作和流程设计;与偏商业化的封闭式 AI 助手相比,它又保留了开源、可部署和可扩展的自由度。

如果你的目标是研究多代理协作、搭建任务编排系统,或为内部团队做一个可解释、可扩展的 agent 工作台,ChatDev 非常值得深入看;如果你的目标只是快速获得单一任务结果,那么更轻的 SaaS 工具、单代理框架或现成助手产品可能会更省时间。也就是说,是否选择 ChatDev,关键不在于它“强不强”,而在于你是否真的需要一个多角色、多阶段、可工程化管理的智能体系统。

结论

总体来看,ChatDev 不是那种一眼就能看懂、五分钟就能彻底上手的 AI 产品,但它是当前多智能体赛道里非常有代表性的开源项目之一。它既保留了早期通信式软件开发代理的标志性思路,又把自身升级成了更通用的多智能体编排平台。对于愿意亲手搭流程、做实验、做集成的人来说,它有很高的研究和实践价值;而对于只想拿现成结果的普通用户,则更适合作为了解 Agent 工作流范式的观察对象。

如果你准备从官方页面开始,我建议先看 GitHub README 首屏理解 2.0 与 1.0 的区别,再看文档索引与 Start Guide,最后再去 PyPI SDK 页面判断是否需要程序化集成。这样能最快建立对 ChatDev 的正确预期:它不是一个简单的 AI 聊天产品,而是一套值得认真研究的多智能体协作平台。

官方来源

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/chat-dev.html -APPMARK

OWL 是一个优化劳动力学习的通用智能体,用于处理现实世界的自动化任务。