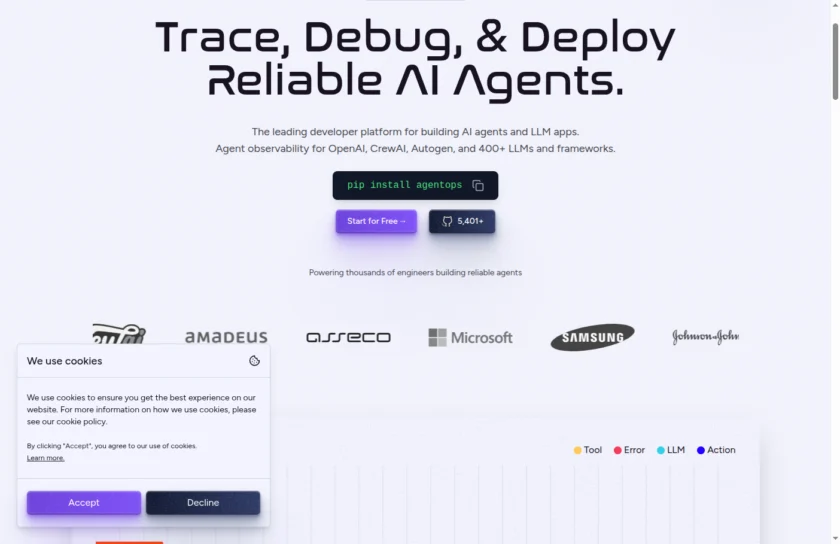

AgentOps 是一个面向 AI 智能体和 LLM 应用的开发者平台,核心任务不是帮你生成内容,而是帮你把已经在运行的 agent 系统“看清楚、调明白、上线稳住”。官方首页直接把定位写成 Trace, Debug, & Deploy Reliable AI Agents,说明它聚焦的是智能体开发中的后半段难题:调用链路看不见、问题难复现、成本难追踪、上线后缺审计。对正在用 OpenAI、CrewAI、Autogen 等框架做 agent 的团队来说,AgentOps 更像一层 observability 与运营控制台,而不是新的 agent 框架本身。

这是什么产品

从官网描述看,AgentOps 是一个 developer platform,服务对象是构建 AI agents 与 LLM apps 的工程团队。它主打 agent observability,并明确支持 OpenAI、CrewAI、Autogen 以及 400+ LLM 与框架。这意味着它不是绑定某一个模型厂商或某一个 agent 框架,而是试图成为跨框架、跨模型的监控与调试中间层。对于已经把智能体接进业务系统的人来说,这种定位非常实用:团队往往不缺“能跑起来的 demo”,缺的是上线后如何看调用、找错误、追成本、审行为,以及在出现异常时如何迅速复现与定位。

首页还给出一个非常明确的上手信号:`pip install agentops`。这说明它不是纯销售型平台,而是开发者可以直接接入 SDK 的产品。与此同时,官方又强调“Powering thousands of engineers building reliable agents”,把重点落在生产可靠性上。换句话说,AgentOps 不负责替你设计业务逻辑,它负责让你已经写出来的 agent 工作流变得可观测、可解释、可维护。

核心功能与工作流

AgentOps 的能力可以概括为四层。第一层是追踪与可视化。官方写到它能可视化追踪 LLM calls、tools、multi-agent interactions,这意味着一个复杂 agent 在运行过程中经历了哪些模型调用、调用顺序如何、工具链怎么串起来,都可以被完整记录。第二层是 Time Travel Debugging,也就是回放式调试。对于多步骤 agent 系统来说,最痛苦的事情往往不是“它错了”,而是“它为什么在那一步错了”,回放能力正是为了解这个问题。第三层是审计与安全。首页明确提到 full data trail、logs、errors、prompt injection attacks,说明它同时承担着审计链路与风险分析角色。第四层是成本管理。它不仅追 token,还追踪成本,并支持跨多个 agents 管理 spend,这对生产环境尤其重要。

如果把它放到实际工作流里理解,典型用法大致是:开发者先在自己的 agent 项目里接入 AgentOps SDK,然后让系统自动记录 LLM 调用、工具调用、会话事件和多智能体交互;当某次运行效果差、成本异常或输出不稳定时,团队可以通过回放、日志、事件导出和可视化页面去排查;如果项目进入生产环境,则继续用它做长期监控、成本观察、权限管理和团队协作。对多 agent 场景尤其如此——没有可观测层时,系统一旦复杂,很快就会变成黑箱。

如何开始使用

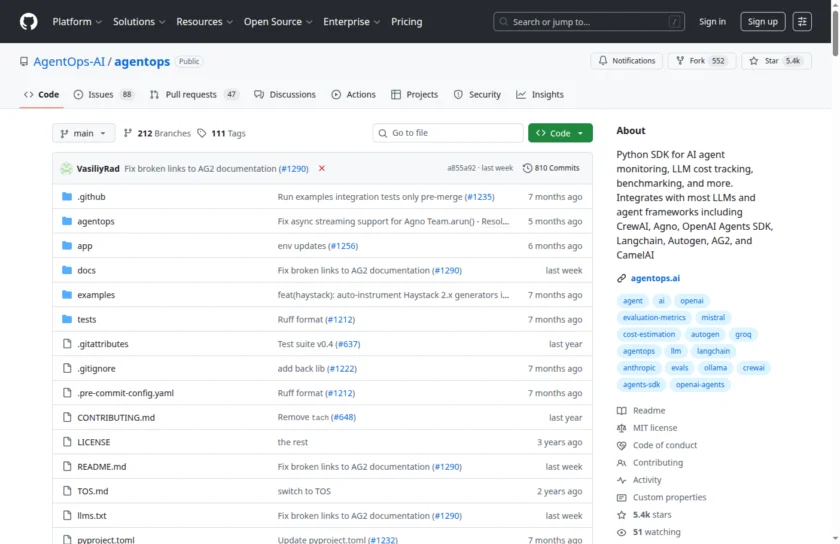

AgentOps 的官网已经把最直接的接入动作写在首页:`pip install agentops`。这意味着它的进入门槛比很多企业销售型平台低得多,更接近开发者工具的使用方式。虽然官网独立 `/docs` 页面当前返回 404,但首页已经明确给出产品定位、SDK 入口、支持框架和价格信息;此外 GitHub 仓库也可以作为 release / distribution 入口补足开发者视角的使用证据。因此,对新用户来说,最合理的上手路径通常是:先看官网理解产品定位,再进 GitHub 或示例文档页查看支持框架与接入方式,随后把 SDK 接进自己的 agent 项目里做第一次追踪。

从产品形态来看,AgentOps 特别适合已经有 agent 原型、准备进入稳定开发或生产阶段的团队。因为一旦开始涉及多模型、多工具、多代理协作,单靠 print 日志或简单埋点很难长期维护。此时先把观测层接上,再继续扩展 agent 能力,通常比等系统复杂后再补监控更划算。

价格、开源状态与部署方式

AgentOps 的价格信息在官网首页已经公开。Basic 为每月 0 美元,免费到 5,000 events;Pro 起价为每月 40 美元,采用 pay-as-you-go;Enterprise 为定制方案。这个价格结构很清楚地表明,它并不是只做企业大单的销售型产品,而是同时覆盖个人开发者、小团队和更大规模组织。官方还列出了 Enterprise 级能力,包括 SLA、Slack Connect、Custom SSO、on-premise deployment、自定义数据保留策略、自托管(AWS、GCP、Azure)以及 SOC-2、HIPAA、NIST AI RMF 等,这说明它在合规和私有化部署方面也有明确路线。

开源状态方面,AgentOps 平台本体是商业产品,但官方同时公开了 GitHub 仓库和 SDK 接入路径,因此更准确地说,它是“开放接入、商业化平台”。部署方式则体现出明显的分层:个人或小团队可以从 Basic / Pro 云端方案起步,而大组织可以走 Enterprise 与私有化路线。对于需要在受监管环境中运行 agent 的团队,这一点会很有吸引力。

pip install agentops从开发者视角看,这条命令是最核心的起点:它意味着 AgentOps 的接入逻辑是 SDK-first,而不是只能通过后台手工配置完成。

适合哪些人和场景

AgentOps 最适合的不是只想体验一个聊天机器人功能的人,而是正在构建或维护 agent 系统的开发团队。尤其当你的项目开始出现以下特征时,它会更有价值:使用多个 LLM、集成多种工具、存在多智能体协同、需要记录成本、需要排查偶发错误、需要审计 prompt injection 或异常行为、需要把原型推向生产。对这些团队来说,AgentOps 能补上的不是“再来一个模型”,而是让系统可运营、可定位、可治理的基础设施。

它也适合 agent 框架使用者,例如 CrewAI、Autogen 以及其它需要在复杂执行链路中追踪状态的工程场景。如果你只是单次调用 API、逻辑非常简单,AgentOps 的价值可能不会充分体现;但只要系统演化成“多步骤 + 多组件 + 长期运行”的 agent 应用,它就会开始变得重要。

优势与限制

AgentOps 的优势很清楚。第一,它定位专一,不抢主框架的角色,而是专注做 agent observability、debugging 与 cost tracking。第二,它对主流 agent 生态兼容度高,支持 400+ LLM 和框架,降低了团队迁移成本。第三,它既有免费入口,也有企业级私有化和合规能力,说明成长路径相对完整。第四,回放调试和完整数据轨迹是很强的生产特性,这类能力在 agent 项目从 demo 走向正式环境时往往决定维护成本。

限制同样存在。当前官网独立 docs / pricing 子页返回 404,说明网站结构或路由稳定性还有改进空间;公开资料里虽然有首页和仓库,但分散的开发文档体验不如一些更成熟的开发者平台。此外,它本身并不帮你解决 agent 业务设计问题——如果你的核心问题是提示词设计、工具选择或业务流程建模,AgentOps 只能帮助你看清问题,而不能替你完成上层产品设计。

对比与选择建议

如果把 AgentOps 放到相邻产品里看,它更像 AI 时代的 observability / APM 工具,而不是新的 agent framework。与直接使用框架自带日志相比,它提供更系统化的可视化、回放、审计和成本追踪;与传统软件监控工具相比,它更贴近 LLM 调用、多代理交互和 prompt 安全问题。对于已经确定要做 agent 的团队,这种“专门面向 agent 系统的监控层”通常比通用日志方案更高效。

因此,选择建议也很明确:如果你已经在做 agent 或 LLM app,并且开始关心可靠性、成本和排障效率,AgentOps 值得优先评估;如果你连 agent 原型都还没搭起来,它的价值会在后续阶段才体现。它最适合用在“系统已经能跑,但还不够稳”的那一段开发周期。

结论

AgentOps 不是让你“多一个智能体”,而是让你现有的智能体系统更可观测、更可调试、更适合部署。它把追踪、回放、审计、成本管理和企业级部署能力打包成一个开发者友好的平台,尤其适合多智能体和生产级 Agent 场景。若你正在从 agent demo 走向真实上线,AgentOps 值得作为基础设施层纳入工具栈;最值得先看的,是首页给出的接入方式、GitHub 分发入口,以及免费/Pro/Enterprise 三档能力差异。

官方来源

- Homepage: https://www.agentops.ai/

- GitHub: https://github.com/AgentOps-AI/agentops

- Pricing overview: https://www.agentops.ai/

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/agentops.html -APPMARK

AI-Researcher 是一个基于大型语言模型的自动化科研工具。AI-Researcher 基于多模态数据集成、LLM 智能代理和自动化实验验证等技术,实现科研任务的高效处理,其核心功能包括支持文献综述、算法设计、实验验证和论文撰写等全流程自动化。