Megatron-LM 是 NVIDIA 持续维护的超大规模 Transformer 训练项目。它不是面向终端用户的聊天产品,也不是一键式托管平台,而是一套给研究团队、基础模型团队和训练平台工程师使用的分布式训练框架。它的核心价值,在于把“如何把数十亿到数千亿参数模型稳定地放到大量 GPU 上训练”这件事,拆成了一套可复用、可组合、性能优先的工程体系。对于只需要调用现成模型 API 的团队来说,它的门槛明显偏高;但对于希望自己训练或深度改造基础模型的人来说,Megatron-LM 仍然是绕不开的重要基础设施。

这是什么项目

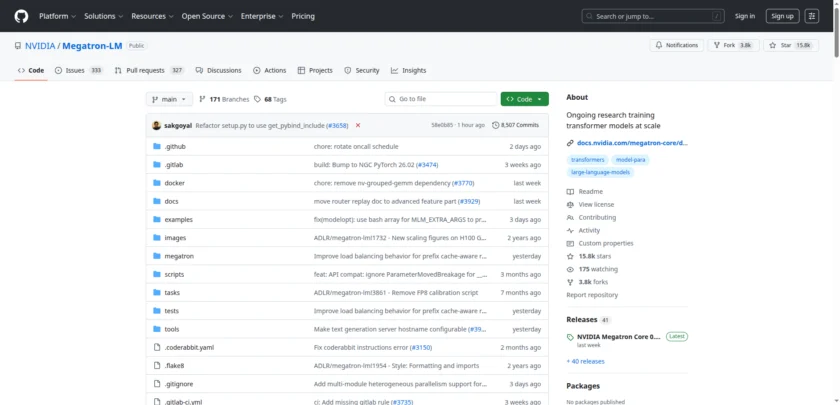

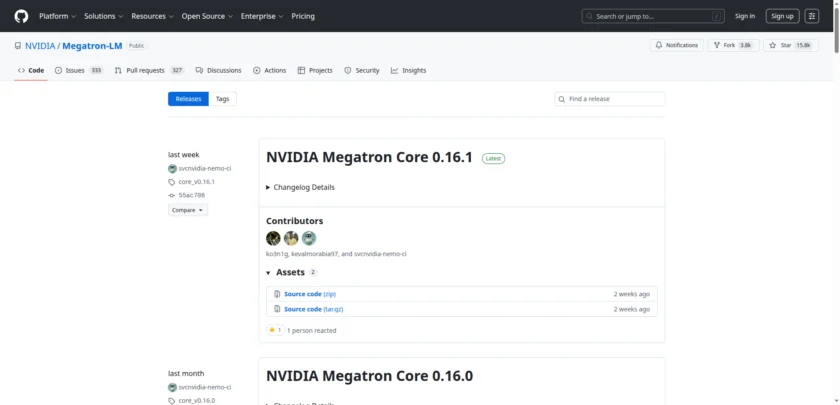

从官方定位看,这个仓库现在包含两个层次:Megatron-LM 与 Megatron Core。Megatron-LM 更像“参考实现 + 训练入口”,在 Megatron Core 的能力之上补齐训练脚本、样例、数据处理工具和端到端工作流;Megatron Core 则是更底层的可组合训练库,提供 transformer building blocks、并行策略、优化器、数据集工具、推理和导出能力。也就是说,Megatron-LM 并不是单一功能的软件,而是一套围绕大模型训练搭建出来的工程栈。

它最早以“大参数模型如何做模型并行训练”而知名,后来随着 NVIDIA 的持续投入,逐步扩展成支持 GPT、BERT、T5、LLaMA、Qwen、Mixtral、Mamba 等架构的大规模训练框架。官方文档明确说明,它通常和 Megatron Core、Megatron Bridge、Transformer Engine、NeMo 等组件配合使用。简单理解,Megatron-LM 解决的是“如何把大模型训练跑起来并跑得足够快”,而不是“如何最低门槛地玩模型”。

如果你熟悉 Hugging Face Trainer、PyTorch Lightning 或 DeepSpeed,会发现 Megatron-LM 的设计哲学更偏底层控制和极致性能。它保留了较原生的 PyTorch 训练循环,抽象层没有那么厚,因此更适合愿意自己掌控训练配置、并行策略、数据流和集群拓扑的团队。这个特点也决定了它更像研究与平台工程工具,而不是大众化 AI 应用。

核心能力与训练工作流

Megatron-LM 的核心竞争力首先体现在并行策略。官方文档把数据并行、张量并行、流水线并行、上下文并行、专家并行列为可组合使用的主要手段。数据并行解决 batch 维度扩展;张量并行把单层内部计算拆到多卡;流水线并行按网络深度分段;上下文并行用于长序列训练;专家并行则服务于 Mixture-of-Experts。真正重要的不只是“支持这些名词”,而是它允许你把这些并行方法组合起来,按 TP × PP × CP × EP × DP 的方式搭出适合特定模型与集群规模的训练拓扑。

第二个关键能力是高效训练优化。官方资料多次强调 mixed precision、FP8、分布式优化器、激活检查点、通信重叠、分布式 checkpoint 等机制。对训练团队来说,这些能力决定了显存占用、吞吐、可恢复性和规模上限。Megatron Core 还和 Transformer Engine、NVIDIA Resiliency Extension 等生态组件联动,用来补强高性能 kernel、故障恢复和训练韧性。

第三个能力是对现代模型形态的覆盖。项目不止支持传统 dense Transformer,也在文档和路线里强调对 MoE、长上下文、多模态与混合架构的支持。官方开发者页面甚至单独强调了 token dropless / token dropping 的 MoE 训练,以及 Mamba 等混合模型路线。这意味着 Megatron-LM 不是只适合“复刻 GPT-3”的旧框架,而是在往新一代基础模型训练体系演进。

典型工作流一般分成几步:先准备 JSONL 等训练数据并做 tokenizer 预处理;再选择模型架构与训练脚本,例如 GPT、LLaMA 或 MoE 样例;随后根据 GPU 数量与序列长度设定并行参数;然后通过 torchrun 在多卡或多节点上启动训练;最后配合 checkpoint、评估和桥接工具,把权重继续导向微调、转换或部署环节。Megatron-LM 并不隐藏复杂度,它是把复杂度显式交给高级用户控制。

如何开始使用

Megatron-LM 的官方上手路径很明确。最轻量的方式是先安装 megatron-core,然后再克隆 Megatron-LM 仓库获取样例和训练脚本。官方 Quick Start 提供了 `pip install --no-build-isolation megatron-core[mlm,dev]` 的安装方法,也给出了在仓库内执行 `pip install --no-build-isolation .[mlm,dev]` 的方式。README 里还提示,如果源码构建时内存不够,可以通过 `MAX_JOBS=4` 之类的环境变量限制并行编译任务数,这类细节对真实训练环境很重要。

首次训练实验可以直接用官方简单例子,例如双卡 mock data 训练脚本,或者运行 LLaMA-3 8B 的示例 shell。数据侧则要求你先准备 JSON/JSONL 文本,再用 `tools/preprocess_data.py` 做 tokenizer 处理,生成二进制数据文件和索引。对从 Hugging Face 生态切过来的人来说,这一步会更“基础设施化”一些,但它的好处是更贴合大规模训练时的数据吞吐需求。

真正的上手难点不在命令,而在参数理解。比如长序列训练时是否要引入上下文并行,隐藏维度较大时张量并行开多大,深层模型是否叠加流水线并行,MoE 模型如何设置 expert parallel,以及是否要开启 sequence parallel、distributed optimizer、overlap-grad-reduce、overlap-param-gather、tp-comm-overlap。这些都不是“默认一把梭”就能选好的,而是要结合模型规模、显存、网络互联和训练目标去调。

开源协议、价格与交付方式

Megatron-LM 本体是开源项目,仓库采用 Apache-2.0 许可证。这一点对企业和研究团队都很关键:它允许你在商业环境里使用、修改和集成,而不像某些限制更强的许可证那样需要额外顾虑。官方也把它放在 GitHub 持续开放开发与 issue 讨论,说明它不是一个只有论文、没有长期工程维护的项目。

从“价格”角度看,Megatron-LM 本身并不按席位收费,也不是典型 SaaS。真正的成本来自 GPU 集群、存储、网络、工程实施和训练时间。换句话说,项目代码免费,但训练大模型的总体成本并不低。尤其当你进入多节点、多机房甚至数千 GPU 的规模时,Megatron-LM 只是把训练效率做高,不能替你消除硬件账单。

它的交付方式也更偏“框架源码 + 文档 + 样例脚本”。如果团队想要更完整的企业级工作流,往往还会把它和 NeMo、Megatron Bridge、Model Optimizer、内部调度平台或推理服务栈结合起来使用。因此,Megatron-LM 更像训练体系的核心引擎,而不是独立完整产品。

适合谁

Megatron-LM 最适合三类用户。第一类是做基础模型预训练、继续预训练或大规模后训练的研究团队,他们需要直接控制模型结构、并行拓扑和训练 loop。第二类是平台工程团队,这类团队要在集群里把训练任务标准化、可恢复化,并在吞吐和显存之间做精细优化。第三类是希望深度理解分布式大模型训练的人,包括实验室、企业研究院和 GPU 资源较强的创业团队。

它不太适合轻量级个人开发者,也不太适合作为“第一款 AI 工具”去体验。原因很简单:你需要懂多卡训练、知道 tokenizer 与数据预处理链路、能看懂 torchrun、并且通常要具备 NVIDIA GPU 环境。哪怕只是为了复现官方脚本,也比普通推理项目复杂得多。如果只是想本地做 LoRA 微调,其他更轻量的框架通常更友好。

但如果你的目标不是“快点试一下”,而是“把训练体系搭深、搭稳、搭到大规模”,Megatron-LM 的价值会非常明显。很多团队不会把它当成唯一系统,但会把它当成训练底座的重要组成部分。

优势与限制

Megatron-LM 的第一大优势,是规模化训练能力已经被 NVIDIA 长期打磨。官方给出的 benchmark 显示,它可以在 H100 集群上训练从 2B 到 462B 参数的模型,并在大规模弱扩展测试中实现较高 MFU;开发者页面还强调其在 6K+ H100 规模下的可扩展性与训练韧性。即便你未必会直接跑到这种规模,这也说明框架的设计目标本来就不是小打小闹。

第二大优势,是并行能力完整且组合灵活。很多工具只强调一种并行方式,而 Megatron-LM 的文档把 TP、PP、DP、CP、EP 的适用场景说得非常清楚,并配了推荐组合。对于超大模型、长上下文和 MoE 来说,这种组合能力决定了你能否把资源真正压榨到位。

第三大优势,是生态衔接能力正在增强。Megatron Bridge 提供 Hugging Face 与 Megatron 之间的 checkpoint 双向转换,文档里还列出和 NeMo、Transformer Engine、Model Optimizer 等组件的关系。对团队而言,这降低了“训练框架”和“模型生态”之间的断层。

它的限制同样明显。首先,使用门槛高,不适合没有分布式经验的用户。其次,项目聚焦训练,不负责帮你处理数据治理、实验管理、权限系统和商业化控制台。再次,虽然支持大量现代特性,但很多最佳实践仍需自己验证,尤其在不同 GPU、不同网络和不同模型架构下,参数没有绝对通用解。最后,只有 GitHub 仓库作为主要入口时,页面表达本身不如商业官网直观,对导航站读者来说也会显得更偏工程文档。

和其他训练框架怎么选

如果把 Megatron-LM 与 Hugging Face Trainer、DeepSpeed、Colossal-AI、NeMo 放在一起看,它的位置更像“极致性能导向的大模型训练参考框架”。和 Hugging Face Trainer 相比,它更重并行与集群性能,但易用性较弱;和 DeepSpeed 相比,它在 NVIDIA 生态下的深度优化与官方基准更突出;和 NeMo 相比,它更轻、更接近底层原生训练框架,适合不想要过厚封装的研究团队。

如果团队已经确定主要运行在 NVIDIA GPU 上,并且目标是 dense LLM、MoE 或超长上下文训练,那么 Megatron-LM 很值得优先评估。反过来,如果你的目标是低门槛微调、中小规模实验,或者你更在乎统一实验管理和更友好的配置系统,那么可以先从别的框架起步,再视规模升级到 Megatron 系列。

一个现实的选择方式是:把 Megatron-LM 当作“训练性能上限”的参考实现,把它和自身业务的工程复杂度一起权衡。你未必需要完全按它的方式组织所有工作流,但如果你正在迈向百亿级以上模型训练,它给出的并行范式和工程路径非常有参考价值。

结论

Megatron-LM 不是大众化 AI 工具,而是一套面向大模型训练核心环节的专业框架。它最适合的使用场景,是在 NVIDIA GPU 集群上高效训练、扩展和优化基础模型,尤其适合需要掌控并行策略、吞吐、显存和训练韧性的团队。对于导航站读者来说,可以把它理解成“大模型训练世界里的重型底座”:不轻巧,但非常关键。

如果你只是想找一个便捷微调工具,Megatron-LM 可能过重;但如果你关心超大规模训练、MoE、长上下文和高性能并行,那么它是必须认识、值得深入阅读文档甚至亲自上手的代表项目。它的学习成本高,但对应的能力上限也很高。

官方来源

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/megatron-lm.html -APPMARK

Unsloth AI 是一个开源 Python 库,旨在通过优化的 GPU 内核和低内存技术,显著加速和优化大型语言模型(LLMs)的微调过程。它支持多种流行的 LLM 架构和微调方法,能够帮助开发者在资源有限的环境下高效地定制和优化 AI 模型。