阿里云 PAI 是阿里巴巴云推出的端到端机器学习平台,旨在为企业及开发者提供云原生、全链路的 AI 开发与服务能力。该平台覆盖了从数据标注、模型构建、分布式训练到模型推理部署的全生命周期,能够显著降低人工智能的应用门槛与研发成本。针对当前主流的 RAG 与大模型应用场景,PAI 提供了深度优化的基础设施与工具链,支持一键部署主流开源大模型并无缝对接向量数据库,帮助企业快速构建私有 AI 知识库。无论是算法工程师还是企业开发者,都能通过其交互式建模环境 DSW、分布式训练引擎 DLC 及在线预测服务 EAS,实现从实验到生产的高效转化,助力业务智能化转型。

阿里云PAI是什么?

产品定位

阿里云 PAI(Platform for AI)是阿里巴巴云推出的端到端机器学习平台,旨在为企业及开发者提供云原生、全链路的 AI 开发与服务能力。该平台覆盖了从数据标注、模型构建、分布式训练到模型推理部署的全生命周期,能够显著降低人工智能的应用门槛与研发成本,助力业务快速实现智能化转型。

核心功能模块

| 模块名称 | 功能描述 | 适用场景 |

|---|---|---|

| PAI-DSW | 交互式建模环境,提供集成的 JupyterLab 界面及丰富的插件支持。 | 算法研发、代码编写、模型调试。 |

| PAI-DLC | 分布式训练加速引擎,支持大规模深度学习任务的高效调度。 | 大模型训练、复杂神经网络计算。 |

| PAI-EAS | 模型在线预测服务,支持高并发、低延迟的弹性推理部署。 | 在线 API 调用、实时业务预测。 |

| PAI-Designer | 可视化建模工具,通过拖拽组件即可完成机器学习工作流。 | 低代码开发、数据预处理、特征工程。 |

技术特性与优势

- 全框架兼容: 深度支持 TensorFlow、PyTorch、MXNet、Caffe、MindSpore 等主流深度学习框架。

- 高性能加速: 依托阿里云强大的 GPU/NPU 资源池,提供优化的分布式通信库(AIACC)和计算加速能力。

- 企业级管理: 提供完善的多租户资源隔离、权限控制、任务监控及日志管理系统,满足企业合规需求。

- 生态集成: 与阿里云 OSS(对象存储)、MaxCompute(大数据计算)、DataWorks 等产品无缝打通,实现数据与算力的闭环。

使用与获取方式

- 开通服务: 访问阿里云官网 PAI 产品页,登录控制台并完成服务开通。

- 资源准备: 根据业务规模选择按量付费或包年包月模式,并创建相应的计算资源组(如 GPU 实例)。

- 开发与部署: 开发者可通过控制台进入 DSW 进行交互式开发,或利用 Designer 搭建自动化流水线,最终通过 EAS 将模型一键部署为 RESTful API 供业务端调用。

阿里云 PAI 目前已广泛应用于金融风控、智能推荐、图像识别、自然语言处理(NLP)及大语言模型(LLM)等多个领域,是构建企业级 AI 基础设施的核心平台。

核心功能

阿里云 PAI(Platform for AI)是面向企业客户及开发者的一站式机器学习平台,旨在提供从数据标注、模型构建、模型训练到模型部署的全链路 AI 开发服务。针对当前主流的 RAG(检索增强生成)与大模型应用场景,PAI 提供了深度优化的基础设施与工具链,帮助企业快速构建私有 AI 知识库。

核心功能模块

| 模块名称 | 功能定位 | 核心能力 |

|---|---|---|

| PAI-DSW | 交互式建模 | 提供云端 JupyterLab 环境,支持多种 GPU/CPU 算力规格动态切换,集成主流深度学习框架。 |

| PAI-DLC | 分布式训练 | 支持大规模集群训练任务,优化梯度同步效率,具备强大的任务调度与资源抢占能力。 |

| PAI-EAS | 在线预测服务 | 提供高并发、低延时的模型推理接口,支持自动扩缩容、蓝绿发布及多种硬件加速。 |

| PAI-Designer | 可视化建模 | 通过拖拽式工作流完成数据处理与算法建模,内置上百种成熟的机器学习算法组件。 |

针对 AI 知识库(RAG)的深度支持

- 大模型快速部署: 通过 PAI-QuickStart 预置主流开源大模型(如 Qwen、Llama、ChatGLM 等),支持一键完成 Embedding 模型与 LLM 的部署。

- 无缝对接向量数据库: 能够与阿里云 DashVector(向量检索服务)深度集成,实现私有文档向量化存储与高效检索。

- 全栈微调能力: 提供 SFT(监督微调)与 RLHF(强化学习)工具链,支持针对特定行业知识库进行模型精调,提升 RAG 系统的回答准确度。

- 高性能算力保障: 依托阿里云底层基础设施,提供稳定的大规模 GPU 算力池,确保知识库在高并发场景下的响应速度。

使用方式

- 控制台可视化操作: 登录阿里云 PAI 控制台,通过图形化界面创建 DSW 实例或配置 EAS 部署任务。

- SDK 与 API 调用: 使用 PAI 提供的 Python SDK 进行自动化实验管理,或通过标准 RESTful API 将部署的模型集成至业务系统。

- 命令行工具: 利用 PAI-CLI 工具在本地终端完成任务提交、资源查询与模型上传。

获取方式

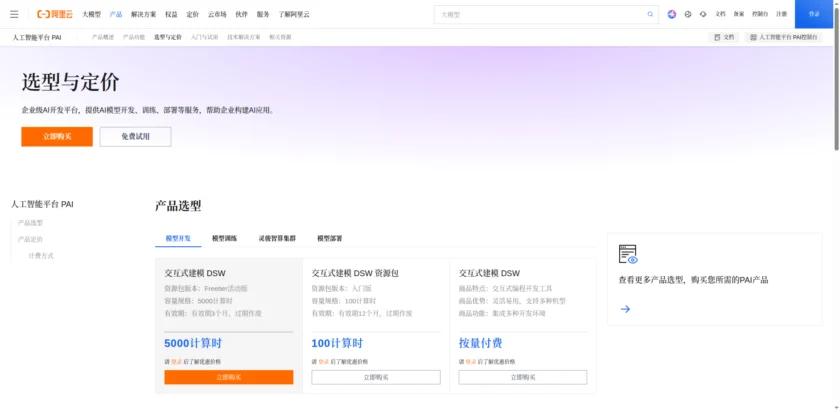

用户可直接访问阿里云官网搜索“PAI”进入产品详情页。目前平台提供免费试用计划,新用户可申请特定规格的算力资源包进行体验。计费模式灵活,支持按量付费(适合短期实验)与包年包月(适合长期生产环境),开发者可根据项目规模选择公共资源池或独享资源组。

如何开始使用?

产品定位与核心能力

阿里云人工智能平台 PAI(Platform for AI)是面向企业级开发者的一站式机器学习与深度学习平台。它提供了从数据标注、模型开发、模型训练到模型部署的全生命周期管理能力。在 AI 知识库(RAG)构建场景中,PAI 凭借其强大的算力调度和预置的大模型工具链,能够显著降低企业构建私有化知识问答系统的门槛。

| 核心组件 | 功能定位 | 在 RAG 场景中的作用 |

|---|---|---|

| PAI-DSW | 交互式建模环境(Notebook) | 用于数据清洗、向量化处理及 RAG 逻辑调试。 |

| PAI-EAS | 模型在线服务(推理) | 部署 LLM 大模型和 Embedding 模型,提供 API 调用。 |

| PAI-DLC | 分布式训练云原生平台 | 支持对基础大模型进行领域知识微调(Fine-tuning)。 |

| PAI-Studio | 可视化建模与工作流 | 通过拖拽组件快速构建数据处理与模型评估流水线。 |

快速上手步骤

- 环境准备: 登录阿里云控制台,搜索并进入“人工智能平台 PAI”。首次使用需完成 RAM 角色授权,并创建一个工作空间(Workspace),这是管理所有 AI 资产的基础单元。

- 资源配置: 在工作空间内配置计算资源。对于 AI 知识库应用,建议在“资源池”中关联 GPU 资源(如 A10 或 T4 规格),以支持大语言模型的流畅推理。

- 部署模型服务:

- 进入 PAI-EAS 控制台,可以从“模型应用中心”一键部署如 Qwen、Llama 等主流开源大模型。

- 部署完成后,系统会生成专用的 API Endpoint 和 Token,用于后续集成。

- 构建知识库链路:

- 利用 PAI-DSW 编写脚本,将本地文档进行切片并调用 Embedding 模型转化为向量。

- 将向量数据存入阿里云向量数据库(如 AnalyticDB 或 DashVector)。

- 编写 RAG 检索逻辑,将检索到的上下文与用户问题一同发送给 PAI-EAS 部署的大模型。

获取方式与计费模式

阿里云 PAI 提供了灵活的获取途径,用户可根据项目阶段选择合适的计费方案:

- 免费试用: 针对新用户,阿里云通常提供 PAI-DSW 和 PAI-EAS 的限额免费试用资源包,方便进行原型验证。

- 按量付费(Postpaid): 适合开发调试阶段,根据实际使用的 GPU/CPU 资源时长和存储空间计费,随用随停。

- 资源包 / 包年包月: 适合生产环境,通过预付费方式购买固定规格的资源池,能够获得更高的性价比和资源保障。

提示:构建 AI 知识库时,建议优先参考 PAI 官方提供的“快速搭建 RAG 聊天机器人”解决方案模板,可大幅缩减环境配置时间。

价格或获取方式

阿里云 PAI(Platform for AI)是面向企业级用户和开发者的一站式机器学习平台,提供从数据准备、模型开发、模型训练到模型部署的全链路 AI 服务。在构建 AI 知识库(RAG)时,PAI 通过其强大的算力调度和模型服务能力,支撑大语言模型的微调与在线推理。

计费模式

阿里云 PAI 根据不同的产品模块提供灵活的计费方案,主要包括以下几种形式:

| 计费模块 | 计费方式 | 说明 |

|---|---|---|

| PAI-DSW(交互式开发) | 按量付费 / 资源包 | 按使用的云服务器(GPU/CPU)规格及时长计费,支持预付费资源包抵扣。 |

| PAI-DLC(分布式训练) | 按量付费 / 资源包 | 根据训练任务消耗的计算资源量进行结算。 |

| PAI-EAS(在线预测) | 按量付费 / 包年包月 | 支持弹性伸缩,根据部署模型所占用的实例规格和运行时间计费。 |

获取方式与流程

- 开通服务:访问阿里云官网,进入“机器学习 PAI”产品详情页,点击“立即开通”。开通本身不产生费用,仅在创建资源或运行任务时计费。

- 免费试用:阿里云为新用户提供“PAI 免费试用计划”,符合条件的用户可以领取一定额度的 PAI-DSW、PAI-DLC 或 PAI-EAS 算力资源,用于初步搭建 RAG 原型。

- 控制台操作:

- 登录 PAI 控制台,创建工作空间。

- 根据需求选择 PAI-QuickStart 快速部署开源大模型(如 Llama、Qwen 等)。

- 通过 PAI-EAS 将模型部署为 API 服务,对接向量数据库完成知识库构建。

- API 集成:用户可以通过阿里云 OpenAPI、Python SDK 或 Java SDK 将 PAI 的各项能力集成至自有业务系统中。

注意:在构建 AI 知识库时,除 PAI 的计算费用外,通常还需结合阿里云对象存储 OSS(存放数据)和向量检索服务 DashVector(存储向量索引)使用,相关产品将独立计费。

适合谁?

阿里云 PAI(Platform for AI)是阿里巴巴云提供的端到端机器学习平台,旨在为企业和开发者提供从数据处理、模型训练到服务部署的一站式 AI 开发环境。在 AI 知识库(RAG)与大模型应用领域,该产品主要面向以下核心受众:

1. 企业级 AI 应用开发者

适合需要快速构建私有化知识库、智能客服或企业助理的团队。PAI 提供了预置的 RAG 解决方案,支持通过 PAI-EAS(模型在线服务)一键部署主流开源大模型(如 Qwen、Llama、ChatGLM 等),并能无缝对接向量数据库,实现高效的检索增强生成应用,显著降低了从零搭建 AI 链路的技术门槛。

2. 数据科学家与算法工程师

适合追求极致建模效率和灵活性的专业人员。用户可以利用以下核心组件进行深度定制化开发:

- PAI-DSW(交互式建模): 提供云端 JupyterLab 环境,支持即开即用的 GPU 算力,适合进行代码级模型微调。

- PAI-Designer(可视化建模): 针对不希望编写复杂代码的用户,通过拖拽式组件即可完成数据清洗、特征工程和算法训练。

- PAI-DLC(分布式训练): 适合需要处理海量数据、进行大规模深度学习任务的团队,支持万卡级别的弹性调度。

3. 寻求 AI 工程化落地的中大型企业

适合需要统一管理 AI 资产、实现 MLOps 流程标准化的机构。PAI 支持全生命周期的模型管理、版本控制及在线监控,帮助企业将 AI 能力从实验室环境快速转化为稳定的生产力服务,并确保计算资源的弹性扩展与成本优化。

获取与使用方式

| 维度 | 说明 |

|---|---|

| 获取途径 | 通过阿里云官网搜索“PAI”进入产品控制台,开通后即可根据需求创建工作空间。 |

| 计费模式 | 支持按量付费(适合短期任务)和包年包月(适合长期稳定业务),提供多种规格的 GPU/CPU 资源池。 |

| 核心优势 | 深度集成阿里云生态(如 OSS 存储、MaxCompute 大数据),提供企业级的安全隔离与高可用保障。 |

优势与局限

核心优势

阿里云 PAI(Platform for AI)作为企业级机器学习平台,在构建 AI 知识库(RAG)及大模型应用开发中展现出显著的技术领先性:

- 全链路一体化能力:提供从数据标注、模型开发(PAI-DSW)、大规模并行训练(PAI-DLC)到在线推理服务(PAI-EAS)的全生命周期管理,有效解决了 AI 开发过程中工具链断层的问题。

- 极致的算力性能:依托阿里云强大的底层基础设施,支持高性能 GPU 集群调度,并通过自研的编译优化技术(PAI-Blade)和分布式训练框架,显著提升大模型的训练效率与推理响应速度。

- 深度的生态集成:与阿里云对象存储 OSS、大数据计算 MaxCompute、向量数据库(如 Hologres、DashVector)无缝对接,能够快速打通企业私有数据到知识库的链路。

- 丰富的模型资源:深度集成 ModelScope(魔搭社区),支持一键调用海量预训练模型,并提供针对 LLM 的微调(Fine-tuning)与强化学习(RLHF)工具,降低了 AIGC 应用的研发门槛。

局限性与挑战

在享受高性能服务的同时,用户也需关注其在特定场景下的限制:

| 维度 | 局限性说明 |

|---|---|

| 学习成本 | 产品功能模块极其丰富且专业性强,对于缺乏云计算基础或机器学习背景的初学者,存在较高的上手门槛。 |

| 成本管理 | 高性能算力资源(如高端 GPU 实例)单价较高,若未合理配置自动扩缩容或资源包,在大规模推理场景下可能产生较高的运营成本。 |

| 环境依赖 | 部分深度优化的加速库与底层架构与阿里云环境深度绑定,对于追求绝对“多云中立”或有极高本地化部署要求的项目,迁移成本较高。 |

获取与使用方式

用户可直接访问阿里云官网产品页,搜索“PAI”进入控制台。产品目前支持按量付费、预付费资源包以及节省计划等多种计费模式。新用户通常可以申请“免费试用”计划,获取 PAI-DSW 或 PAI-EAS 的限额免费算力,通过内置的镜像和 Notebook 示例快速搭建基于 RAG 架构的 AI 知识库原型。

结论

阿里云 PAI(Platform for AI)是阿里巴巴云原生的一站式机器学习平台,定位为企业级 AI 研发与应用的基础设施。它集成了数据标注、模型开发、分布式训练及在线预测等全链路能力,旨在通过高性能计算资源和标准化的工程流程,帮助开发者降低 AI 模型构建的复杂度,提升从实验到生产的转化效率。

核心功能组件

- PAI-DSW(Data Science Workshop):云端交互式建模环境,支持主流深度学习框架,提供开箱即用的 Notebook 开发体验。

- PAI-DLC(Deep Learning Containers):分布式训练加速引擎,支持大规模参数模型的高效迭代与资源调度。

- PAI-EAS(Elastic Algorithm Service):在线预测服务,支持将模型一键部署为高可用、低延迟的 RESTful API,适配多种硬件环境。

- PAI-Designer:可视化建模工具,通过拖拽式组件快速构建机器学习工作流,降低算法开发门槛。

使用与获取方式

用户可直接访问阿里云官网(aliyun.com/product/pai)获取服务。在获取方式上,PAI 支持按量付费、资源包抵扣及预付费等多种灵活计费模式,并为新用户提供免费试用额度。开发者只需登录阿里云控制台,即可快速创建工作空间,利用平台内置的行业算法模板和预训练模型,加速 AI 知识库(RAG)及各类生成式 AI 应用的落地进程。

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/pai.html -APPMARK

Chroma 是一款高性能开源向量数据库,采用 Apache 2.0 协议,专为 RAG 架构和 LLM 应用提供语义搜索支持。它具备极简的部署流程,支持 HNSW 算法索引,并能与 LangChain 等主流 AI 框架深度集成,是构建智能化知识库的核心工具。