DeepSpeed 是什么:定位、组件与使用边界

从定位上看,DeepSpeed 更像一套“训练运行时 + 配置系统 + 启动器”。你仍然可以沿用现有的 PyTorch 模型与训练循环,但需要把关键策略写进配置文件,并通过 DeepSpeed 提供的入口启动训练作业。这样做的好处是:优化策略从脚本逻辑中剥离,变成可版本化的配置,便于回滚、对比与审计。

在实践里,DeepSpeed 常被用于三类任务:1)分布式训练(尤其是显存瓶颈明显、需要细粒度调度的场景);2)推理加速与服务化(把模型加载、批处理与执行路径工程化);3)与主流训练栈集成(例如在既有训练框架或工具链中启用 DeepSpeed 配置)。需要注意的是,它不是“开关一开就变快”的黑盒,任何优化都应以你的基线测试与监控指标为准。

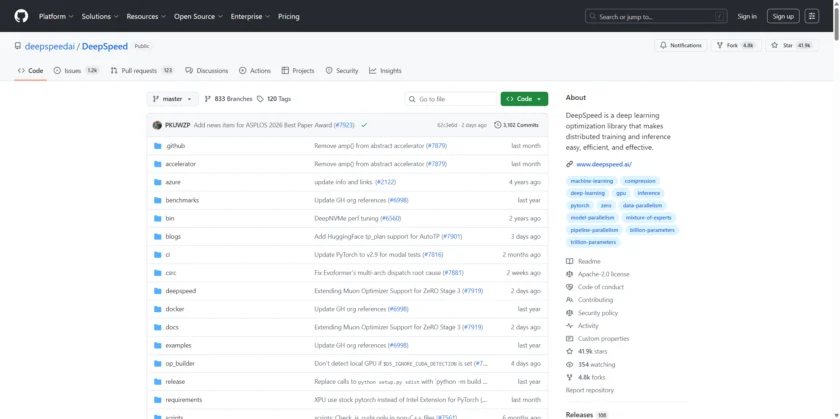

建议以官方站点与仓库为事实来源:DeepSpeed 官网、Docs、microsoft/DeepSpeed(GitHub)。

核心能力:显存治理、并行与训练加速的组合拳

DeepSpeed 的核心卖点之一是 ZeRO 相关的内存优化思路:把训练过程中占用显存的关键对象(模型参数、梯度、优化器状态等)按数据并行 rank 进行分片与调度,从而把单卡无法承受的显存压力分摊到多卡上。对大模型来说,OOM 往往不是“batch 太大”这么简单,而是多类状态叠加导致的峰值;因此把它们拆开治理通常更有效。

在并行策略方面,DeepSpeed 经常与张量并行、流水线并行等方式组合使用。工程上你需要做出的关键决策包括:分片粒度与通信频率如何选择、通信与计算如何重叠、checkpoint 如何保存与恢复、以及在故障或资源抢占后是否能稳定续训。DeepSpeed 的价值在于把这些策略显式化,让你用配置与日志来管理复杂度,而不是把分布式细节散落在脚本各处。

在训练加速层面,它通常会与混合精度(fp16/bf16)、梯度累积、激活重计算等手段协同。需要强调的是,官方与社区的性能结论通常依赖于具体模型、序列长度、数据加载与硬件环境;更稳妥的做法是先建立可复现的吞吐与显存基线,再逐项引入策略并验证收益。

如何开始:安装、启动与配置文件的工程化建议

DeepSpeed 的上手通常从两条路径之一开始:要么在现有 PyTorch 训练脚本中接入初始化逻辑,并使用 DeepSpeed 启动器运行;要么在集成框架(例如 Transformers 的训练器等)中启用 DeepSpeed 配置。无论哪条路径,关键都在于把“运行参数”与“优化策略”放进可追踪的配置文件里,而不是临时写在命令行或脚本分支中。

一个可维护的配置拆分方式是把参数分成三类:1)数据与批量相关(micro-batch、累积步数、序列长度、数据加载并发等);2)数值稳定性相关(fp16/bf16、loss scale、梯度裁剪、溢出处理等);3)分布式策略相关(ZeRO 阶段、offload、通信优化、并行维度等)。当遇到 OOM、发散或吞吐异常时,这种结构能让你按层排查并快速回滚到可运行的最小配置。

落地时建议准备一份“自检清单”,用来减少分布式环境中的不确定性:先用单机单卡跑通数据与 loss 曲线,再启用单机多卡验证通信与吞吐;对多机训练,确认网络带宽与通信后端配置一致,并把环境信息(CUDA、驱动、PyTorch、DeepSpeed 版本)写入日志;对每次实验固定随机种子与数据切分方式,并设置可恢复的 checkpoint 周期。这样即使引入更复杂的并行或 offload 策略,也能在出现问题时快速定位是数据管线、数值稳定性,还是分布式策略本身导致的异常。

官方文档与教程页通常会随着版本迭代而更新,配置项也可能有差异,因此建议以最新 Docs 为准:Docs、Tutorials。

推理与部署:从训练脚本走向线上服务

在推理阶段,DeepSpeed 的关注点从“如何把训练跑起来”转为“如何稳定地加载与执行模型”。常见落地方式包括离线批量推理(强调吞吐与稳定)与在线推理服务(强调延迟与资源隔离)。无论哪种方式,都建议先用小模型或小流量验证执行路径,再逐步扩大规模,避免直接在生产环境中引入过多变量。

推理侧更容易踩坑的地方通常与训练不同,例如权重加载路径、张量并行切分方式、量化策略兼容性、以及不同 CUDA/驱动版本带来的算子差异。更稳妥的做法是优先采用官方示例与文档推荐的方式逐步接入,并用压测数据验证延迟、显存峰值与吞吐。

优势与限制:把可扩展性换成工程复杂度

DeepSpeed 的优势是把大模型训练里最“硬”的部分工程化:显存与通信的治理、策略的配置化、以及与主流训练栈的集成。但对应的代价是配置与组合更复杂。策略越激进(更深的分片、更重的 offload、更多并行维度),就越需要更严格的监控与实验纪律,否则容易出现“显存省了但吞吐下降”的结果。

建议建立三条底线:1)始终保留一个可运行的最小配置作为回滚点;2)把关键指标(吞吐、step time、显存峰值、通信等待)统一口径写进日志;3)每次只改一类策略,避免同时改 batch、精度、并行导致无法定位因果。对于团队协作,把配置文件、启动命令与环境信息(驱动/CUDA/PyTorch 版本)一起版本化记录通常能显著降低沟通成本。

对比与选型:什么时候优先考虑 DeepSpeed

如果你的目标是把大模型训练稳定跑起来,或者你需要在相同硬件预算下把显存压力降到可控,并且团队愿意投入工程复杂度去换可扩展性,DeepSpeed 往往是更优先的选择。相反,如果模型规模并不大、训练栈更偏向“简单可维护”,你可能更倾向采用更轻量或更上层的分布式方案,把复杂度留在框架里而不是交给配置组合。

做选型时可以重点比较三件事:1)你的主要瓶颈是显存还是通信还是数据加载;2)你是否需要可复现、可审计的配置管理与稳定的续训机制;3)团队是否能承担配置复杂度与排障成本。DeepSpeed 往往更适合“训练规模持续增长、需要把工程化能力沉淀下来”的团队,而不是一次性的短期实验项目。

最终仍建议以官方文档与仓库示例为准,并以你自己的基线测试结果验证:Docs、Releases、GitHub。

官方来源

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/deepspeed.html -APPMARK

PEFT (Parameter-Efficient Fine-Tuning) 是 Hugging Face 提供的一个库,旨在通过多种参数高效的微调技术,帮助开发者以低成本的方式将预训练好的大型语言模型适配到各种下游任务中,显著降低计算和存储需求。