llama.cpp 是一个基于纯 C/C++ 编写的高性能大语言模型推理引擎,最初由 Georgi Gerganov 开发,旨在实现大模型在消费级硬件上的本地化运行。它坚持零依赖的设计哲学,支持包括 Llama 3、Qwen、Mistral 在内的数十种主流开源模型。通过引入创新的 GGUF 文件格式和先进的 K-Quants 量化算法,该工具显著降低了显存占用,使得用户能够在普通笔记本电脑、MacBook 甚至移动设备上流畅运行百亿参数规模的模型。作为目前本地 AI 推理领域的工业标准底层框架,它不仅提供了极致的推理性能,还通过对 Metal、CUDA 及 Vulkan 等多种硬件加速技术的支持,打破了 AI 运算对昂贵显卡的依赖,是构建私有化 AI 应用和边缘计算方案的核心引擎。

llama.cpp是什么?

项目定位与技术背景

llama.cpp 是由 Georgi Gerganov 开发的高性能大语言模型(LLM)推理引擎,最初旨在实现 Meta LLaMA 模型在 MacBook 上的本地运行。该项目采用纯 C/C++ 编写,坚持“零依赖”的设计哲学,现已演变为支持数十种主流开源模型(如 Mistral、Gemma、Qwen、Llama 3 等)的通用推理框架。其核心使命是打破硬件壁垒,通过极致的底层优化,让大模型能够在从普通笔记本电脑、移动端设备到专业服务器的各类硬件上高效运行。

核心技术架构亮点

- GGUF 标准格式: llama.cpp 引入并推广了 GGUF 文件格式。作为 GGML 的继任者,GGUF 支持单文件分发,能够将模型权重、分词器配置及元数据完整封装,并具备极佳的向前兼容性,解决了模型加载时的配置碎片化问题。

- 先进的量化算法: 提供了从 1.5-bit 到 8-bit 的多种量化方案(如 K-Quants 系列)。通过对模型权重进行有损压缩,显著降低了显存和内存占用,使得 70B 规模的大模型也能在消费级显卡或大内存 PC 上流畅运行。

- 内存映射(mmap): 支持将模型文件直接映射到虚拟内存,实现秒级加载速度,并允许操作系统根据需要灵活管理内存分页,极大提升了资源调度效率。

- SIMD 指令集优化: 针对不同 CPU 架构进行了深度指令级优化,包括 x86 平台的 AVX/AVX2/AVX512 以及 ARM 平台的 NEON 指令集,确保在纯 CPU 环境下依然具备可用的推理速度。

多平台硬件加速支持

| 硬件平台 | 加速技术 | 技术优势 |

|---|---|---|

| Apple Silicon | Metal API | 深度适配统一内存架构,在 Mac 设备上实现极高的 Token 生成效率。 |

| NVIDIA GPU | CUDA | 支持全量或部分模型层(Layer)卸载至显存,充分发挥 Tensor Core 的算力。 |

| AMD / Intel GPU | ROCm / SYCL / Vulkan | 通过跨平台图形接口实现硬件加速,提供广泛的兼容性支持。 |

| 移动端 / 边缘端 | ARM NEON / Android | 针对低功耗处理器优化,支持在手机及嵌入式设备上进行本地离线推理。 |

适用人群与应用场景

llama.cpp 专为追求极致推理性能和本地私有化部署的开发者设计。它适用于对数据隐私有严格要求、需要在无网络环境下运行 AI 应用、或希望在有限硬件资源(如仅有 CPU 或小显存显卡)下探索大模型能力的个人用户与企业。由于其代码结构精简且易于集成,它已成为众多第三方 AI 客户端(如 Ollama、LM Studio)和边缘计算方案的核心底层引擎。

安装与运行

环境要求与技术依赖

llama.cpp 采用纯 C/C++ 编写,其核心设计目标是极简的依赖关系与高度的可移植性。在安装运行前,需确保系统环境满足以下要求:

- 编译器: 需要支持 C++11 标准的编译器。在 Linux 上推荐 GCC 或 Clang;macOS 推荐使用 Xcode 自带的 Clang;Windows 推荐使用 Visual Studio (MSVC) 或 MinGW。

- 构建系统: 项目原生支持 Make 和 CMake(3.13+)。对于大多数用户,直接在根目录执行

make即可完成基础构建。 - Python 环境: 若需处理原始模型权重(如将 Safetensors 转换为 GGUF 格式),需安装 Python 3.8+ 及其依赖库(如 torch, numpy, sentencepiece)。

- 硬件加速库:

- Apple Silicon: 默认通过 Metal API 调用 GPU 加速。

- NVIDIA GPU: 需安装 CUDA Toolkit 以启用显卡加速。

- AMD/Intel GPU: 支持通过 ROCm、Vulkan 或 SYCL 后端进行驱动。

安装方式

项目提供了灵活的获取途径,涵盖了从底层源码到容器化部署的多种需求:

| 安装途径 | 适用场景 | 主要特点 |

|---|---|---|

| 源码编译 | 性能追求者、开发者 | 可针对特定 CPU 指令集(如 AVX512)进行极致优化。 |

| 预编译二进制 | 普通用户、快速验证 | GitHub Releases 直接下载,无需配置开发环境,支持主流 OS。 |

| Docker 镜像 | 服务器部署、环境隔离 | 官方提供多种后端镜像(CPU, CUDA),避免复杂的驱动配置。 |

| 包管理器 | macOS/Linux 用户 | 支持通过 brew install llama.cpp 等命令一键安装。 |

基本运行与配置步骤

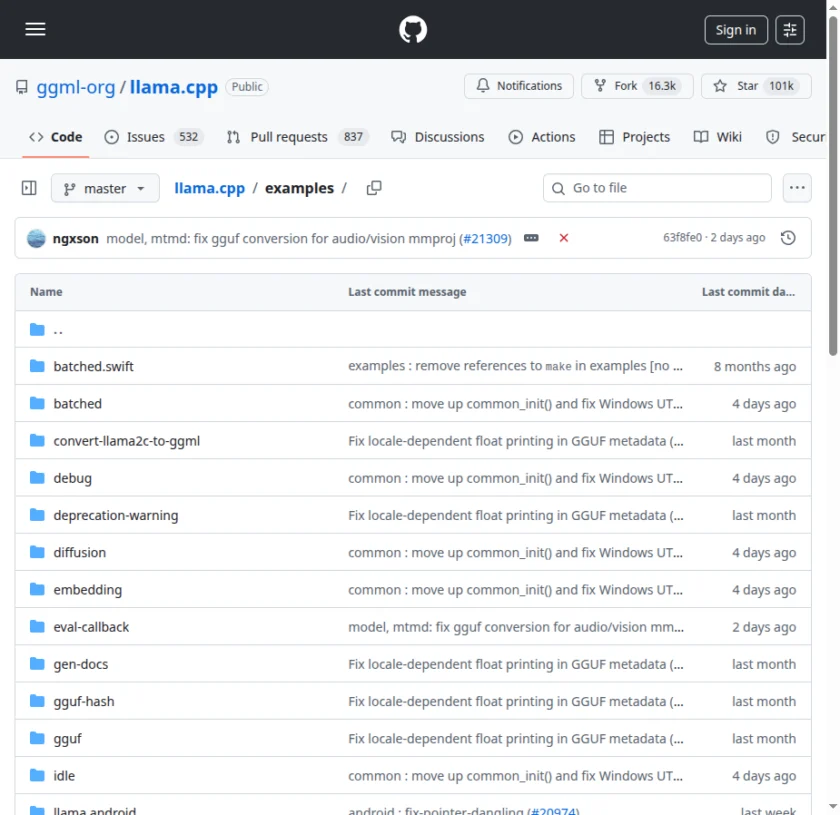

llama.cpp 的运行流程通常分为编译、模型准备和执行推理三个阶段:

- 编译构建:在终端进入项目目录,根据硬件环境执行编译。例如启用 CUDA 加速:

cmake -B build -DGGML_CUDA=ON cmake --build build --config Release编译完成后,会在

build/bin/目录下生成llama-cli(命令行工具)和llama-server(HTTP 服务端)。 - 模型准备:项目仅支持 GGUF 格式。用户可以直接从 Hugging Face 下载已量化的模型,或使用内置脚本转换原始权重:

python3 -m pip install -r requirements.txt python3 convert_hf_to_gguf.py models/Llama-3-8B/ - 启动推理:使用

llama-cli进行基础对话测试,通过-m指定模型路径,-ngl指定加载到 GPU 的层数:./llama-cli -m ./models/llama-3-8b-q4_0.gguf -p "You are a helpful assistant." -ngl 32

许可版本与适用人群

许可协议: llama.cpp 遵循 MIT 许可证。这是一种极度宽松的开源协议,允许个人、研究机构及企业在闭源商业产品中免费使用、修改和分发代码,仅需保留原作者的版权声明。

适用人群:

- 本地 AI 开发者: 需在个人电脑(尤其是 MacBook)上低延迟运行大模型的开发者。

- 边缘计算工程师: 在树莓派、移动端或其他资源受限的嵌入式设备上部署 AI 能力的技术人员。

- 隐私敏感型用户: 拒绝云端 API,追求数据完全本地化处理的个人或企业。

- 量化算法研究者: 需深入底层探索不同位宽(如 IQ4_XS, Q2_K)对模型性能影响的科研人员。

许可、版本与社区

开源许可证

llama.cpp 采用高度宽松的 MIT 许可证。这意味着开发者可以自由地在个人、教育或商业项目中集成该工具,仅需在衍生软件中保留原始版权声明和许可声明即可。这种极低的法律门槛是其迅速成为本地大模型推理基础设施核心组件的关键原因之一。

版本迭代与演进

项目不采用传统的长周期大版本发布模式,而是保持高频的滚动更新。其版本演进呈现以下特点:

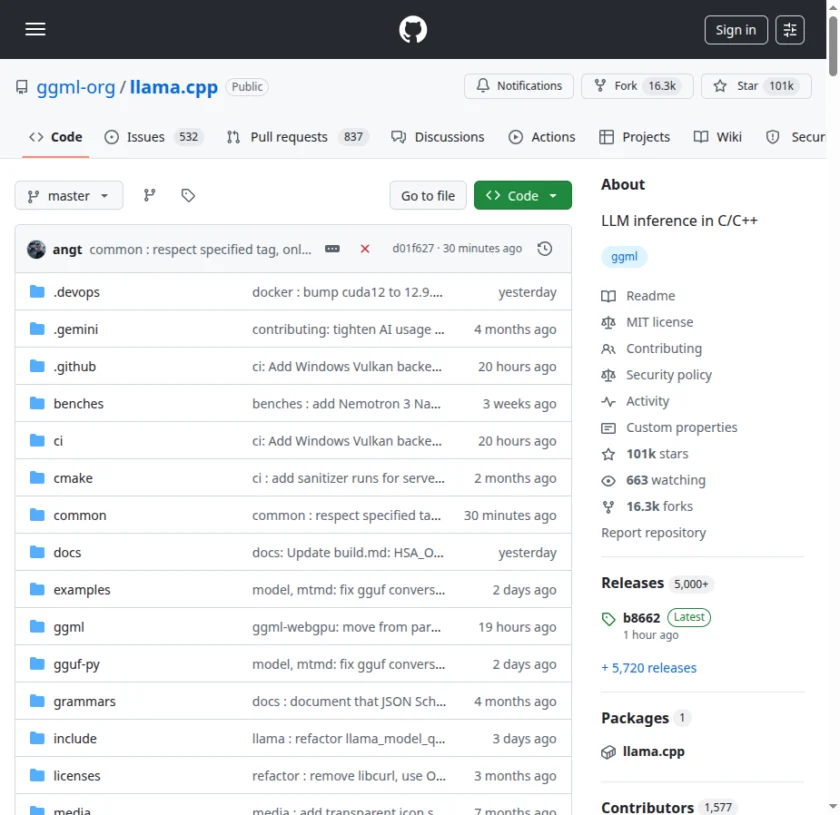

- 持续集成: GitHub 仓库几乎每日都有代码提交,主要通过 Tag 记录关键的功能里程碑。

- 格式演进: 经历了从早期 GGML 到现行 GGUF 格式的重大架构迁移。GGUF 解决了版本兼容性问题,支持在不破坏向后兼容性的前提下添加新张量和元数据。

- 前沿支持: 社区对新模型的响应速度极快,通常在 Meta、Mistral 等厂商发布新模型后的 24 小时内,相关量化支持便会合并至主分支。

社区活跃度与贡献方式

llama.cpp 拥有一个极其活跃的全球开发者社区,目前在 GitHub 上已获得超过 60,000 个 Star,核心贡献者数百人。其生态影响力体现在:

| 维度 | 描述 |

|---|---|

| 下游生态 | 为 Python (llama-cpp-python)、Go、Rust、Node.js 等多种语言提供了绑定库,是 Ollama、LM Studio 等知名客户端的底层引擎。 |

| 贡献途径 | 开发者可以通过提交 Pull Requests 参与核心 C++ 实现、优化特定硬件(如 Metal, CUDA, ROCm)的算子,或参与 GGUF 模型的量化转换工作。 |

| 问题反馈 | 项目维护者对 Issue 的响应速度极快,社区讨论聚焦于推理性能优化、内存占用压缩以及新硬件架构的适配。 |

对于普通用户,参与社区最直接的方式是测试不同硬件下的推理表现并反馈 Benchmark 数据;对于开发者,则可以通过实现新的量化算法或优化计算内核来提升项目性能。

适合谁?

目标用户群体

llama.cpp 凭借其卓越的推理效率和极简的依赖关系,主要面向以下四类核心用户:

- 本地 AI 爱好者与隐私倡导者:希望在不支付云端 API 费用、不泄露个人数据的前提下,在个人电脑(尤其是配备 Apple Silicon 的 Mac)上流畅运行大语言模型。

- 跨平台应用开发者:需要将 LLM 推理能力集成到 C++、Rust、Go 或 Node.js 等非 Python 环境的应用程序中,追求极小的分发体积和极高的运行稳定性。

- 边缘计算与嵌入式研究员:在树莓派(Raspberry Pi)、移动设备或工业网关等资源受限的硬件上部署 AI 模型,进行端侧智能化的实验与落地。

- 企业私有化部署团队:在金融、医疗或政务等对数据合规性要求极高的场景下,利用现有服务器资源(如高内存 CPU 服务器)构建完全离线的 AI 工作流。

典型应用场景对比

| 场景类型 | 典型需求 | llama.cpp 的优势 |

|---|---|---|

| 个人办公 | 本地代码辅助、文档摘要、私人助理 | 支持中低端硬件,不占用昂贵的显存资源,响应速度快。 |

| 产品集成 | 在桌面软件或移动 App 中嵌入 AI 功能 | 无 Python 运行时依赖,易于打包分发,跨平台兼容性极佳。 |

| 学术研究 | 测试不同量化算法对模型性能的影响 | 提供完善的量化工具链,支持从 1.5-bit 到 8-bit 的多种精度。 |

| 离线环境 | 在无互联网连接的内网环境部署模型 | 完全本地化运行,支持 CPU/GPU 混合推理以榨干现有硬件性能。 |

对于拥有多张顶级数据中心显卡(如 H100)且追求极致并发吞吐量的超大规模集群用户,分布式推理框架可能是更专业的选择;但对于单机用户、移动端开发以及异构硬件环境,llama.cpp 是目前社区公认的底层核心工具。

优势与局限

核心优势

- 极致的跨平台兼容性: 采用纯 C/C++ 编写,完全脱离了对 Python 运行时环境的依赖。除了在 x86 架构上表现出色,它对 ARM 架构(尤其是 Apple Silicon 的 Metal 框架)提供了原生级别的深度优化,使得在消费级 MacBook 上运行大模型成为行业标杆。

- 高效的内存管理与量化技术: 引入并主导了 GGUF 格式,支持从 1.5-bit 到 8-bit 的多种量化方案。通过 K-Quants 等先进技术,在大幅降低显存和内存占用的同时,能将模型困惑度(Perplexity)的损失控制在极低范围内,实现了在低配硬件上运行大规模参数模型的可能。

- 硬件加速覆盖广泛: 除了支持 CPU 向量指令集(AVX2, AVX-512),还通过统一的后端抽象层支持了 CUDA、Vulkan、OpenCL、SYCL 以及 ROCm 等多种 GPU 加速方案,确保了从嵌入式设备、个人电脑到高性能服务器的全面适配。

- 轻量化集成: 提供简洁的 C 风格 API,极易被集成到其他编程语言(如 Rust、Go、Node.js)编写的应用中,是目前构建本地 AI 应用最主流的底层引擎。

已知局限

- 模型格式转换成本: 无法直接加载 Hugging Face 上的原始 Safetensors 或 PyTorch 权重。用户必须先使用配套脚本将模型转换为 GGUF 格式,这在处理频繁更新的实验性模型时增加了额外的操作步骤。

- 功能聚焦于推理: 该项目的设计初衷是高性能推理(Inference),并不支持模型的训练(Training)或大规模微调(Fine-tuning)。对于需要全流程开发的用户,仍需依赖 PyTorch 或 TensorFlow 等重型框架。

- 新架构适配延迟: 虽然社区响应极快,但对于完全改变注意力机制或拓扑结构的全新模型架构,其底层算子的 C++ 实现往往会滞后于基于 Python 的原生实现几天甚至数周。

与同类项目的关键差异

| 对比维度 | llama.cpp | vLLM | Transformers (HF) |

|---|---|---|---|

| 核心定位 | 本地化、跨平台、低资源推理 | 云端、高吞吐、服务端部署 | 科研、训练、全功能开发 |

| 依赖环境 | 极简(仅需 C++ 编译器) | 复杂(Python, CUDA, PagedAttention) | 标准(Python, PyTorch/TF) |

| 硬件重心 | CPU + GPU 混合加速 | 高性能 NVIDIA GPU 专用 | 通用(主要依赖 GPU) |

| 部署复杂度 | 极低(单文件二进制运行) | 中等(容器化部署为主) | 中等(需配置 Python 环境) |

结论

llama.cpp 凭借其卓越的 C/C++ 实现,已成为本地大模型推理领域的“工业标准”底层框架。它不仅定义了高效的 GGUF 格式,更通过对硬件指令集的深度优化,打破了高性能 AI 运算对昂贵显卡的绝对依赖,极大地推动了私有化部署的普及。

使用建议

- 技术选型: 对于追求“开箱即用”体验的普通用户,建议优先选择基于此项目封装的 GUI 工具(如 Ollama、LM Studio);而对于需要精细化控制内存占用、自定义量化权重或进行二次开发的工程师,直接调用其原生 API 或命令行工具是唯一路径。

- 硬件匹配: 在非 NVIDIA 环境(如 Apple Silicon、Intel/AMD CPU)下,llama.cpp 是目前性能表现最稳定、资源利用率最高的方案。

- 版本管理: 鉴于项目代码库迭代极快,建议在生产环境中锁定特定的 Git Commit Hash,并定期在测试环境验证新版本对算子优化的提升,以平衡稳定性与性能增益。

综合来看,llama.cpp 是连接开源大模型与消费级硬件的关键桥梁。无论是在个人隐私保护、边缘计算还是企业私有化部署场景中,它都提供了目前最为成熟、高效且具备长久生命力的落地路径。随着 GGUF 生态的持续扩张,掌握该工具的使用已成为 AI 开发者处理本地化推理任务的必备技能。

本文采用 CC BY-NC 4.0 许可协议。商业转载、引用请联系本站获得授权,非商业转载、引用须注明出处。

链接:https://appmark.cn/sites/llama-cpp.html -APPMARK

DeepSpeed 是微软的开源加速库,覆盖 ZeRO memory、稀疏注意力、自动混合精度、推理服务和刀片级异构调度,面向大规模 PyTorch 训练/推理。